서 론

재료 및 방법

벼 도복 영상 수집 및 전처리

Deep Learning 모델

자료 분류

모델 학습

벼 도복 면적 평가

결과 및 고찰

벼 도복 이미지

벼 도복 이미지 학습 성능

벼 도복 면적 평가

적 요

서 론

우리나라는 7~9월에 태풍이 빈번하게 발생하고 있으며, 태풍으로 인해 작물에 직접적으로 피해를 끼치고 있다(Park & Kim, 2009; Park & Park, 1984). 특히 태풍의 강한 바람으로 벼가 차는 시기인 등숙기에 벼가 도복이 되어 벼 이삭에 싹이 트는 현상인 수발아 피해가 발생하고 있으며, 이러한 피해는 벼의 수량과 미질에 큰 영향을 미친다(Kim et al., 2008). 최근 태풍으로 인한 도복 피해규모를 보면, 2020년 태풍 ‘바비’와 ‘마이삭’ 그리고 ‘하이선’으로 인해 전북 8,419 ha, 충남 4,261 ha, 전남 3,407 ha, 경기 1,348 ha 등 전체 17,435 ha이였다(MAFRA, 2020).

해마다 반복되는 도복 피해를 신속하게 대처하기 위해 도복 피해 면적을 신속하고 정확하게 산정할 필요가 있다. 기존의 도복 면적 산정 방법은 전문가가 직접 피해지역을 방문하여 조사하는 달관조사로 시간과 노동에 많은 비용이 들고, 신속ᆞ정확한 도복 피해 산정은 어려운 실정이다(Han et al., 2018). 하지만 인공위성과 무인기 등을 이용한 영상 관련 기술들이 급격하게 발전하고 있으며, 전문가가 현장에 직접 방문하지 않고도 관련 자료를 수집할 수 있다.

최근 첨단 기술을 이용하여 도복 면적을 추정하는 연구들이 진행되고 있다(Wilke et al., 2019; Yang et al., 2015).먼저 인공위성을 이용한 벼 도복 면적을 추정하는 연구로, Yang et al. (2015)는 2013년 중국의 몽골리아 지역에 위치한 농장에서 Synthetic aperture radar (SAR) 위성 이미지를 여러 시기에 걸쳐 수집하였으며, 수집된 SAR 이미지의 Time- series 자료를 이용하여 밀의 도복 면적을 추정하는 연구를 진행하였다. 인공위성은 날씨와 구름의 영향을 많이 받으며, 신속하게 자료를 얻지 못하는 단점이 있다(Khabbazan et al., 2019; Robinson et al., 2019). 이 같은 단점을 보완하여 무인기를 이용한 벼 도복 면적 추정 연구들이 진행되고 있다. Wilke et al. (2019)는 2016년 독일 Bonn대학교의 실험포장에서 무인기로 획득한 RGB 이미지를 이용하여 3D 모델링 프로그램으로 정사모익 이미지와 3D 포인트클라우드를 생성하였고, 생성된 두 개의 자료로 군락의 높이를 계산하는 모델을 구축하여 보리의 도복 면적을 추정하였다. 이러한 연구들은 도복 면적을 신속하게 추정할 수 있지만, 무인기로 촬영한 이미지를 접합하는 과정에서 pixel들의 정밀한 GPS 좌표 값을 얻기 위해 사전에 측량이 필요하다(Nesbit & Hugenholtz, 2019; Shahbazi et al., 2015).

이미지 분류 및 분석에 인공지능을 이용한 예측 기술이 빠르게 보급되고 있다. 인공지능은 예측에 필요한 자료를 수집하여 인공지능 모델을 학습시키고, 학습시킨 모델로 결과를 예측하는 기술이다(Im et al., 2018; VerMilyea et al., 2020). 인공지능 중에서 심층학습이라는 고차원의 Deep learning 기술이 있으며, 그 중에서 이미지 분석에 적합한 Convolutional Neural Network (CNN)이 많이 이용되고 있다(Kim, 2021; Park, 2020). CNN은 영상 기반으로 여러 라벨의 이미지를 학습시켜, 해당 이미지가 어느 라벨에 속하는 지 판단해준다(Jang & Cho, 2016; Krizhevsky et al., 2012). 인공지능을 이용하여 관련 자료를 수집하고 모델을 학습하여 쉽고 정확하게 예측을 할 수 있다.

본 연구의 목적은 최신 영상 기반 Deep Learning 모델인 CNN을 이용하여 벼 도복 피해를 신속하게 대응할 수 있도록 벼 도복 면적을 신속하면서 간단하게 추정할 수 있는 초기 시스템을 개발하는 것이다.

재료 및 방법

벼 도복 영상 수집 및 전처리

2020년 가을, 태풍 ‘마이삭’과 ‘하이선’의 강한 바람으로 인해 전북 지역에 벼가 도복이 되는 피해가 발생하였으며, 9월 4일과 9월 25일, 10월 7일, 10월 14일에 걸쳐 도복 피해가 많이 발생한 김제시, 부안군, 군산시 일대의 농지를 대상으로 DJI의 매빅 프로 드론을 이용하여 5 m, 10 m 및 20 m 고도에서 RGB 영상을 수집하였다(Fig. 1).

수집한 영상은 동영상과 이미지이며, 동영상은 윈도우10의 동영상 재생 프로그램인 ‘영화 및 TV’의 ‘비디오에서 사진 저장’ 기능을 이용하여 이미지로 저장하였다. 이미지의 크기는 4,000 × 3,000이며, python 언어(Python software Foundation, https://www.python.org/)로 128 × 128의 픽셀의 크기로 분할하였다.

Deep Learning 모델

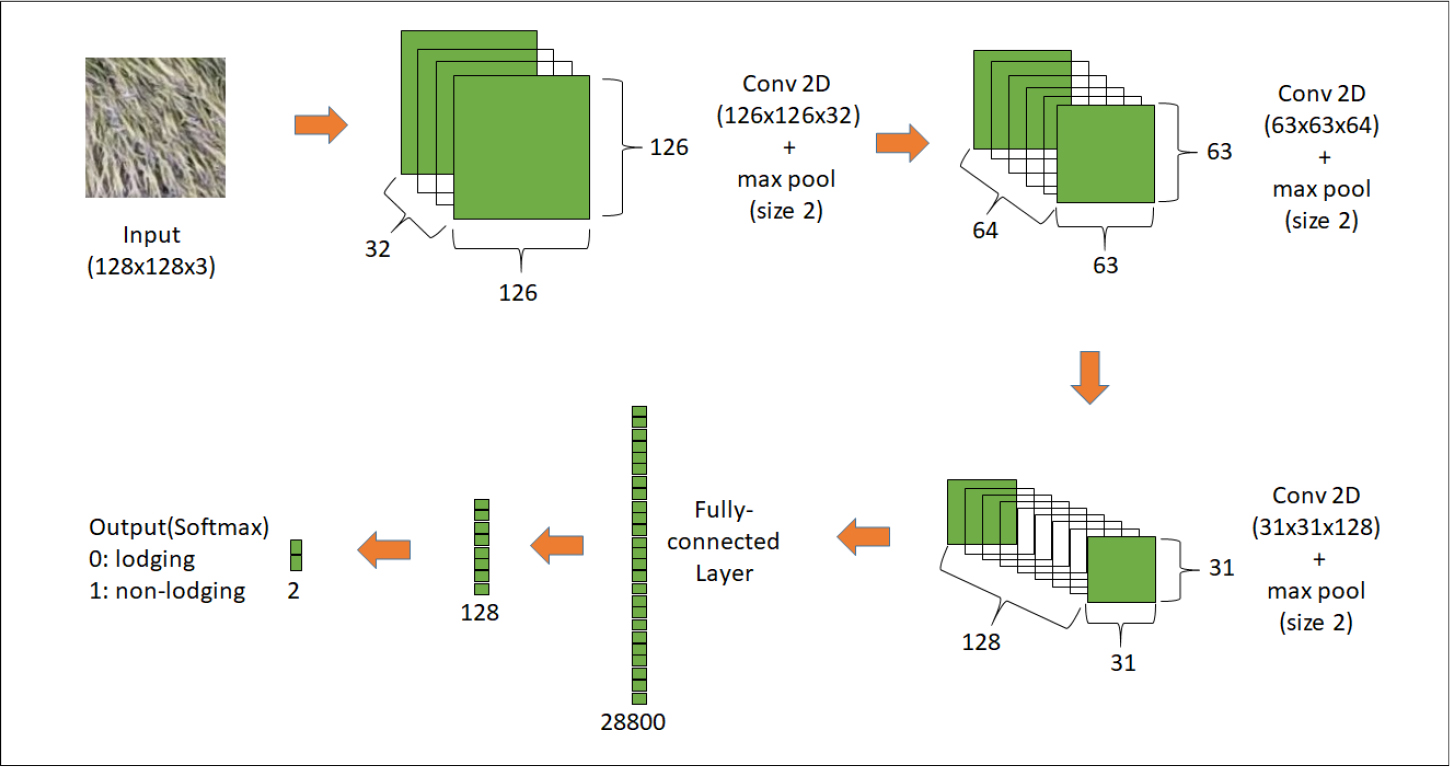

본 연구에서 Deep Learning 모델 중 이미지 기반 분류에 가장 많이 사용되고 있는 Convolutional Neural Network (CNN; Fukushima, 1980)을 python 언어로 코딩하였으며, python의 tensorflow (version 2.0) 라이브러리를 이용하여 CNN을 구동하였다.

CNN 모델은 컨볼루션 필터(convolution filter)를 사용하고 공간적인 특징을 추출하여, 그 특징으로 이미지들을 분류를 하는 모델(Kim et al., 2018)로 모델의 정확도는 0.0에서 1.0사이로 1.0에 가까울수록 정확도가 높다.

자료 분류

모델 학습을 하기 위해 우선 각 이미지들마다 라벨(label)을 정해주었다. 라벨은 도복(lodging)과 정상(non-lodging) 2가지로 구분하였으며, lodging 이미지와 non-lodging 이미지는 각각 65,184개와 66,272개이었다.

모델 학습을 위해 두 라벨의 이미지들을 training을 위한 training-set과 validation을 위한 vali-set으로 분류를 하였다. 분류는 python의 keras 라이브러리의 ImageDataGenerator 함수를 이용하였으며, 랜덤으로 training-set과 vali-set를 8:2의 비율로 분류하였다. Training-set과 vali-set은 각각 105,166개와 26,290개이었다.

모델 학습

CNN 모델은 convolutional layer와 pooling layer, 그리고 fully connected layer로 구성되어 있으며(Lee et al., 2017), layer를 사용자가 직접 구성하여 학습을 할 수 있다. 본 연구에서는 모델을 학습하기 위해 쉽고 간단하게 모델을 구성하였다(Fig. 2).

모델 학습은 학습을 진행하는 과정에서 손실 함수의 결과 값을 낮출 수 있는 매개변수 값을 찾기 위한 것으로(Joo et al., 2020), 매개 변수 값을 찾는 여러가지 optimizer들이 있다. 그 중 많이 이용되는 optimizer로 Adam과 Rmsprop, 그리고 SGD를 이용하여 모델을 학습하였다. 학습을 위한 설정으로 각 optimizer별로 학습 진행 수(epoch)를 100으로 설정하였으며, 입력 이미지의 크기는 128 × 128의 픽셀로 설정하였다.

벼 도복 면적 평가

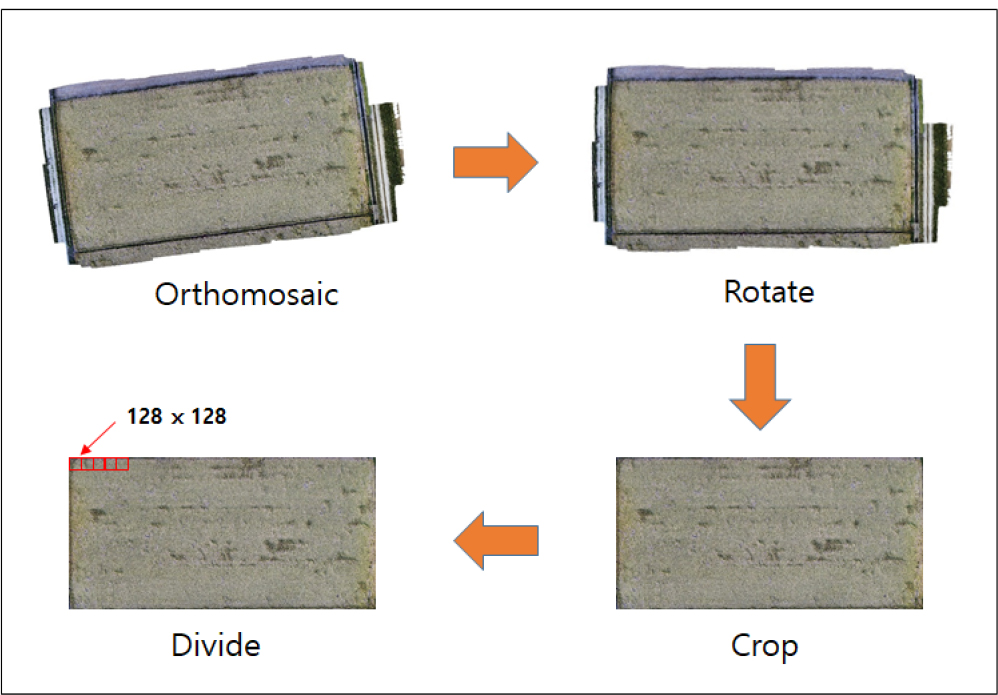

모델의 정확도를 평가하기 위해 CNN 모델 학습과 검증 자료인 training-set과 vali-set에 포함되지 않은 자료를 이용하였으며, 평가 자료는 10월 7일과 10월 14일 군산 및 부안 일대에서 수집하였다. 벼 도복 면적은 한 필지에 대한 면적을 계산하기 위해 수집된 이미지들을 3D 모델링 프로그램 중 하나인 Metashape 프로그램(Agisoft Metashape 1.7.0, Agisoft LLC, Russia)으로 하나의 큰 이미지를 생성하였다. 도복 여부를 판단하기 위해 생성된 이미지를 오픈소스 이미지 처리 프로그램 중 하나인 GIMP (gnu image manipulation program)를 이용하여 이미지를 회전하고 농지에 맞게 잘라내었고, Python 언어로 CNN 모델의 입력 크기인 128 × 128의 픽셀 크기로 분할하였다(Fig. 3). 총 3개의 농지에 대하여 작업을 수행하였으며, 평가할 농지의 분할한 이미지 개수는 5,050개, 6,210개, 그리고 8,400개이었다.

농지의 전체 면적은 QGIS 프로그램(QGIS 3.14-Pi, QGIS Geographic Information System, Open Source Geospatial Foundation Project)을 이용하여 각 농지의 전체 벼 재배 면적을 측정하였고, 벼 도복 면적 측정은 GIMP 프로그램을 이용하여 전체 농지 이미지에서 도복이 된 부분을 표시하여 전체 픽셀 대비 표시된 픽셀의 비율로 도복 비율을 계산하였고, 전체 벼 재배 면적에 도복 비율을 곱하여 벼 도복 면적을 계산하였다(Table 1).

Table 1.

The total area, area of lodging, and lodging ratio of the three fields examined in this study.

| Field no. | Area (m2) | lodging ratio (%) | |

| total | lodging | ||

| Field_1 | 4359 | 4180 | 95.9 |

| Field_2 | 1490 | 556 | 37.3 |

| Field_3 | 2142 | 1075 | 50.2 |

모델을 이용한 3개의 농지의 벼 도복 면적 평가를 위해 각각의 optimizer로 이미지들의 도복 유무를 예측하여 전체 필지의 도복 비율을 계산하고, 필지의 면적을 곱하여 도복 면적을 추정하였다. 추정된 벼 도복 면적 평가는 Root Mean Square Error (RMSE)와 Normalized Root Mean Square Error (NRMSE)로 정확도를 평가하였으며, RMSE와 NRMSE의 계산 식은 다음과 같다.

여기서, 추정 값, 는 측정 값, 그리고 는 측정 값들의 평균을 나타낸다. NRMSE는 excellent (NRMSE < 10%), good (10% < NRMSE < 20%), fair (20% < NRMSE < 30%), pool (NRMSE > 30%)을 나타낸다(He et al., 2018).

결과 및 고찰

벼 도복 이미지

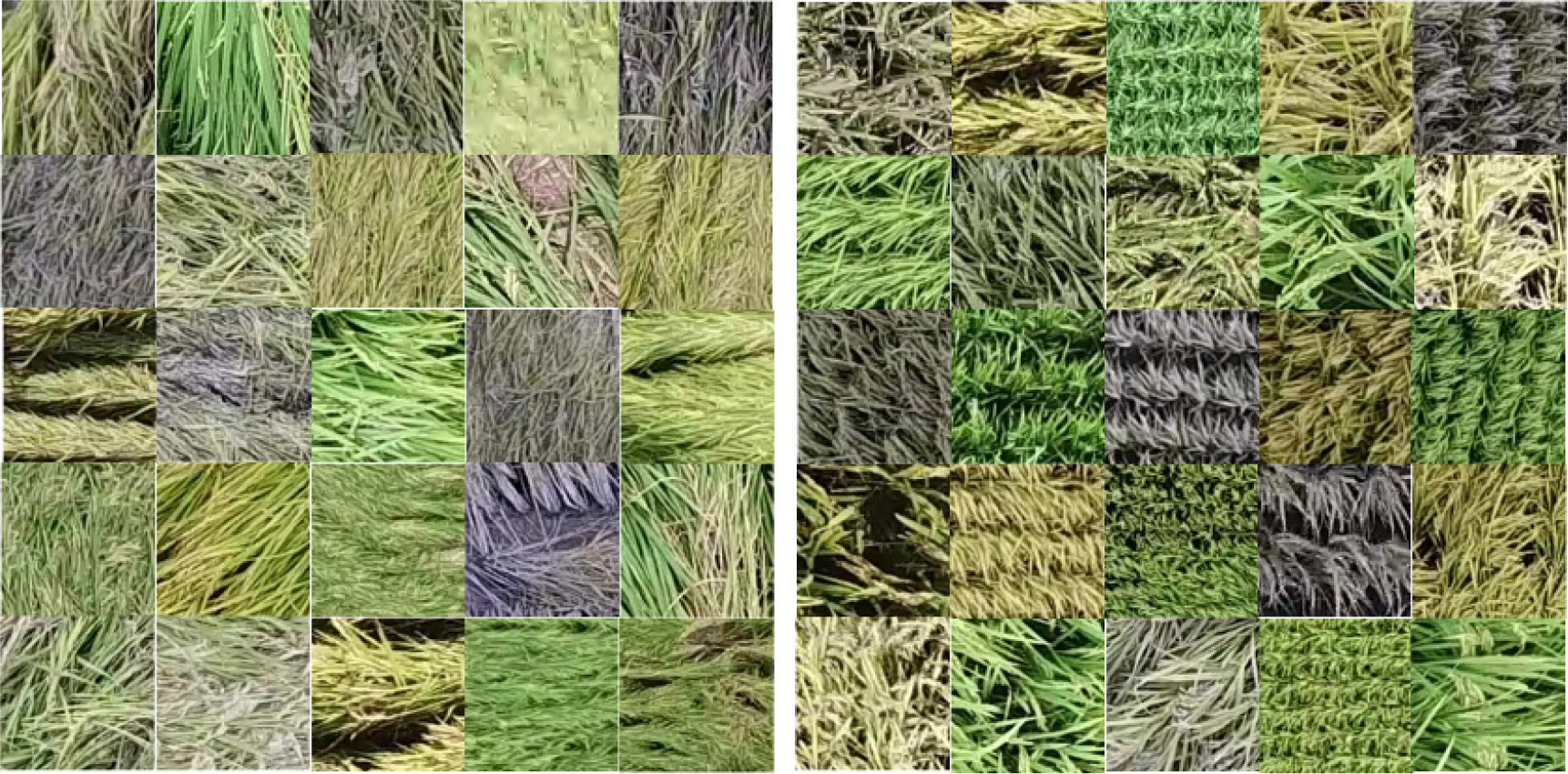

다음은 여러 시기 및 지역과 다양한 고도에서 수집한 이미지들을 전처리하여 lodging와 non-lodging 라벨로 구분된 이미지들을 나타내었다(Fig. 4).

이미지들을 전체적으로 살펴보면, 촬영 날짜에 따라 벼의 생육 단계가 달라 벼의 색깔이 차이를 보이며, 촬영 고도 및 방향에 따라 이미지의 해상도와 벼의 방향이 다른 것을 알 수 있다. 또한 lodging 이미지들과 non-lodging 이미지들을 비교해보면 뚜렷한 특징이 있다. non-lodging의 이미지들은 벼의 재식 거리가 일정하여 벼가 반복되게 나타나며, lodging 이미지들은 바람에 의해 벼가 사방으로 흩어져 있거나 한 방향으로 뉘어져 있다. 이미지 기반 CNN 모델은 이러한 특징들 뿐 아니라 사람이 알기 힘든 특징도 추출하여 결과를 예측할 수 있다(Miao et al., 2019; Yadav & Jadhav, 2019; Zhou et al., 2017).

본 연구에서 벼 도복 비율이 100% (lodging)와 0% (non-lodging)로만 구분이 되지만, 벼 도복 비율대로 라벨을 여러 개로 정한다면 좀 더 정확도를 높일 수 있을 것으로 판단된다. 하지만, 좀 더 상세한 라벨에 대한 부분을 무시할 만큼 벼 도복 면적을 평가에서 전체 이미지에서 이미지 한 개의 비중은 아주 작게 차지한다. 예를 들어, Field_1의 경우 농지의 전체 이미지 개수가 5,050개로 이미지 한 개의 비중은 0.0198%로 아주 작게 차지한다. 또한 도복이 된 영역에서 테두리인 경계부분에서 lodging과 non-lodging이 섞여있을 수 있지만, 이미지가 128 × 128 픽셀로 크기가 작아 이미지의 도복 비율은 큰 영향을 미치지 않을 것으로 판단된다.

벼 도복 이미지 학습 성능

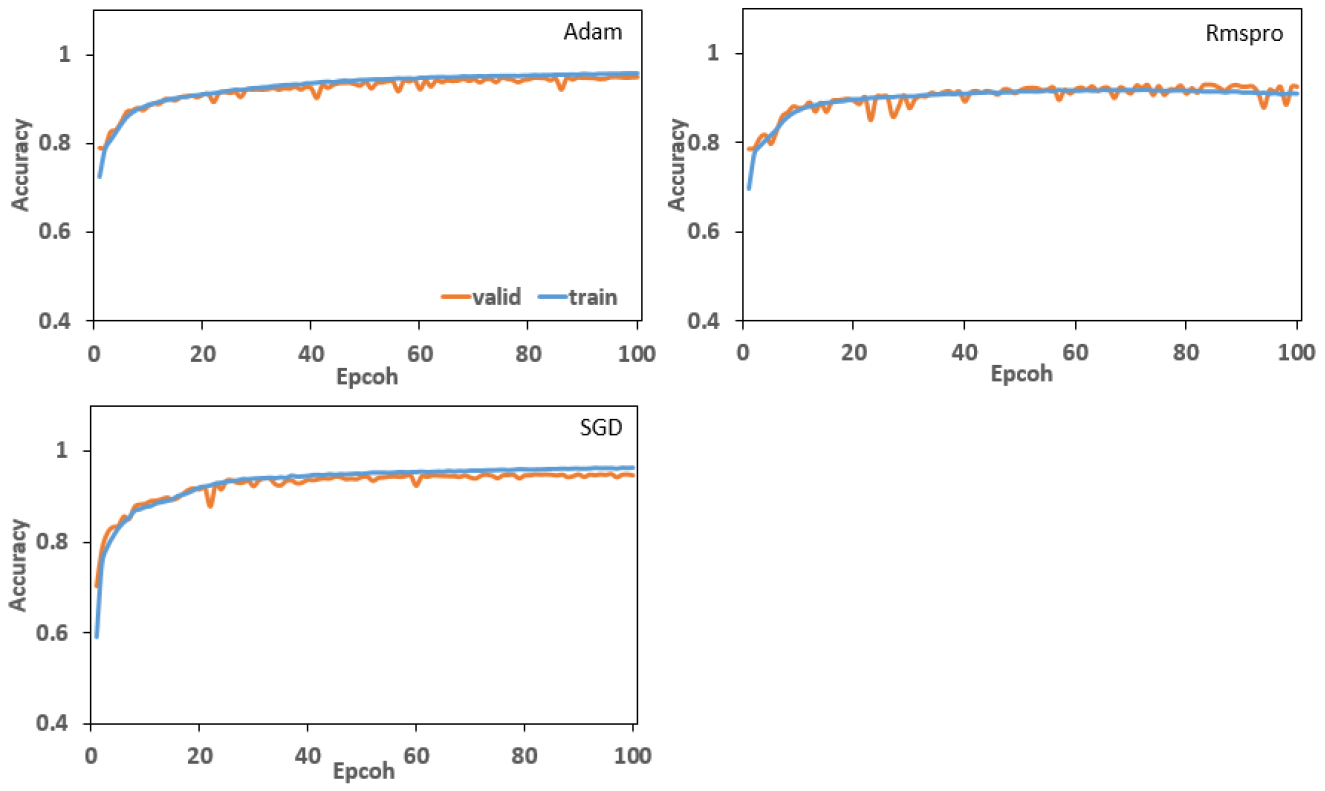

벼 도복 예측에 대한 학습 결과, 각 optimizer의 학습에 따른 training-set과 vali-set의 정확도를 나타내었다(Fig. 5).

optimizer 모두 학습이 진행될수록 training-set과 vali-set의 정확도가 점차 증가하였으며, 3가지 optimizer 모두 높은 정확도를 보였다. training-set과 vali-set의 정확도가 Adam은 각각 0.725~0.957과 0.791~0.950이었으며, Rmsprop는 0.695~0.919와 0.787~0.930, 그리고 SGD는 0.590~0.963와 0.701~0.951이었다. 학습 초기에는 SGD는 정확도가 가장 낮았지만 후기에는 가장 높게 나타났으며, Adam의 정확도는 SGD보다 약간 낮지만 비슷하였다. optimizer 중에서 Rmsprop가 가장 낮은 정확도를 나타내었다. optimizer의 파라미터 설정에 따라 정확도가 달라질 수 있지만(Lim et al., 2017), 정확도가 가장 낮은 Rmsprop의 정확도가 0.919로 optimizer 모두 높은 정확도를 나타내었다.

벼 도복 면적 평가

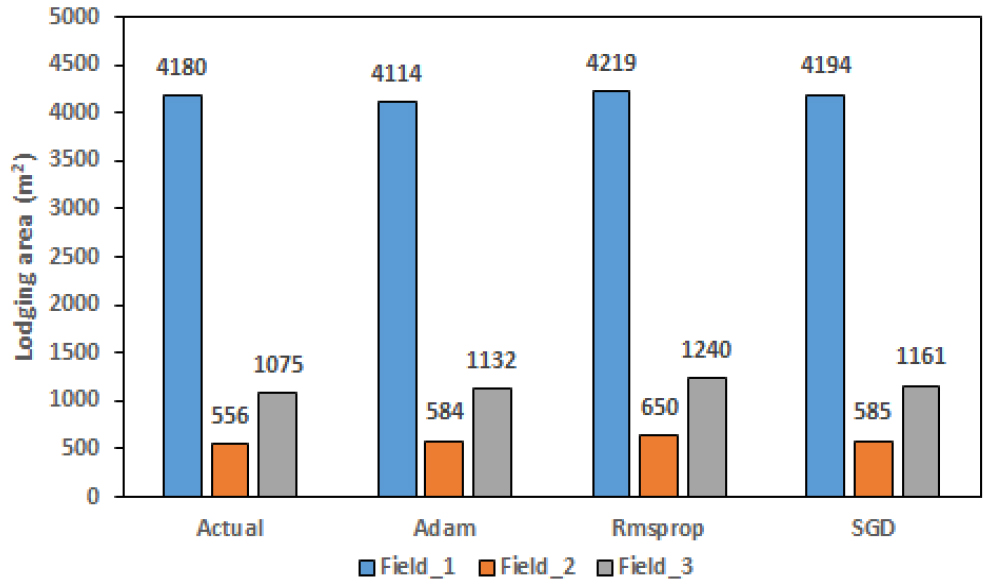

3개의 농지의 실제 벼 도복 면적과 학습된 모델을 이용하여 추정한 벼 도복 면적들을 비교하였다(Fig. 6).

optimizer 모두 실제 벼 도복 면적과 비슷하게 추정되었으며, optimizer 중에서 Rmsprop가 3개의 농지 모두 실제 도복 면적과 비교하여 차이가 크게 나타났다. Field_1은 SGD가 가장 가깝게 추정되었으며, Field_2와 Field3은 Adam이 실제 벼 도복 면적과 가장 가깝게 추정되었다. 3개 농지에 대한 모델의 예측 정확도를 평가하기 위해 RMSE와 NRMSE를 계산하였다(Table 2).

Table 2.

Statistical indices for rice lodging area based on optimizer analysis.

| Optimizer |

RMSE (m2) |

NRMSE (%) |

| Adam | 52.80 | 2.73 |

| Rmsprop | 111.81 | 5.77 |

| SGD | 53.04 | 2.74 |

RMSE와 NRMSE는 Adam이 52.80 m2와 2.73%로 가장 높은 정확도를 나타내었으며, SGD는 53.04 m2와 2.74%로 Adam과 거의 차이가 없었다. Rmsprop의 RMSE와 NRMSE는 111.81 m2와 5.77%로 가장 낮았지만, NRMSE< 10%로 아주 높은 정확도를 나타냈으며(He et al., 2018), optimizer 모두 높은 정확도를 나타내었다. 본 연구에서는 최대한 모델을 간단하게 구성하여 최소한의 설정으로 모델을 학습하였으며, 높은 정확도를 나타내었다. 추후 연구로 optimizer들의 인자들을 좀 더 세밀하게 설정하거나 정확도가 높다고 검증된 pre-trained 모델들을 이용하여 학습한다면 정확도를 좀 더 높일 수 있을 것으로 판단되며, 본 연구에서 이미지의 크기가 128 × 128 픽셀로 설정되었지만 이미지의 크기를 좀 더 크게 혹은 작게 설정하여 추가 실험을 수행한다면 벼 도복 면적 추정 정확도를 높일 수 있을 것으로 판단된다.

적 요

해마다, 강한 바람을 동반한 태풍 및 집중호우로 인해 벼 도복이 발생하고 있으며, 이삭이 여무는 등숙기에 도복으로 인한 수발아와 관련된 피해를 발생시키고 있다. 따라서, 신속한 피해 대응을 위해 신속한 벼 도복 피해 면적 산정은 필수적이다. 벼 도복과 관련된 이미지들은 도복이 발생된 김제, 부안, 군산일대에서 드론을 이용하여 수집하였고, 수집한 이미지들을 128 × 128 픽셀로 분할하였다. 벼 도복을 예측하기 위해 이미지 기반 딥 러닝 모델인 CNN을 이용하였다. 분할한 이미지들은 도복 이미지(lodging)와 정상 이미지(non-lodging) 2가지로 라벨로 분류하였고, 자료들은 학습을 위한 training-set과 검증을 위한 vali-se을 8:2의 비율로 구분하였다. CNN의 층을 간단하게 구성하여, 3개의 optimizer (Adam, Rmsprop, and SGD)로 모델을 학습하였다. 벼 도복 면적 평가는 training-set과 vali-set에 포함되지 않은 자료를 이용하였으며, 이미지들을 methshape 프로그램으로 전체 농지로 결합하여 총 3개의 농지를 평가하였다. 도복 면적 추정은 필지 전체의 이미지를 모델의 학습 입력 크기(128 × 128)로 분할하여 학습된 CNN 모델로 각각 예측한 후, 전체 분할 이미지 개수 대비 도복 이미지 개수의 비율을 전체 농지의 면적에 곱하여 산정하였다. training-set과 vali-set에 대한 학습 결과, 3개의 optimizer 모두 학습이 진행됨에 따라 정확도가 높아졌으며, 0.919 이상의 높은 정확도를 보였다. 평가를 위한 3개의 농지에 대한 결과는 모든 optimizer에서 높은 정확도를 보였으며, Adam이 가장 높은 정확도를 보였다(RMSE: 52.80 m2, NRMSE: 2.73%). 따라서 딥 러닝을 이용하여 신속하게 벼 도복 면적을 추정할 수 있을 것으로 예상된다.