서 론

재료 및 방법

시험 포장 환경 및 엽면적 측정

영상 데이터 수집 및 전처리

RGB 기반 생육지수 분석

기계학습 모델 데이터 구성 및 전처리

기계학습 모델 구축 및 평가

RGB 기반 생육지수와 기계학습 모델을 활용한 엽면적지수 평가

결과 및 고찰

엽면적 및 엽면적지수 시계열 변화

기계학습 모델 학습 결과 및 평가

생육지수 및 기계학습 모델 간 상관관계 분석

생육지수 및 기계학습 모델 기반 엽면적지수 평가

분얼기와 유수형성기 시기별 엽면적지수 분석

적 요

서 론

최근 농작업 자동화 기술과 디지털 기술이 발전함에 따라 스마트 농업 및 정밀 농업이 더욱 부상하고 있다. 스마트 농업과 정밀 농업은 인공지능 및 자동화 기술을 통해 작물 생장을 정밀하게 제어하고 필요한 곳에 적정량의 자원을 투입함으로써 현대 농업의 여러 문제에 대응할 수 있는 방안으로 생각되고 있다(Karunathilake et al., 2023; Shafi et al., 2019; Song et al., 2022). 이러한 농업 기술이 실제로 잘 적용되기 위해서는 작물 생육 모니터링 과정이 필수적이며, 농업 연구에서 작물 형질을 정확하게 측정하고 분석하는 것은 안정적인 재배 기술 개발 및 관리를 위해 중요하다(Das et al., 2019). 특히 엽면적은 작물의 생육을 한눈에 확인할 수 있는 대표적인 생육 지표이다. 대부분의 작물에서 잎은 광 흡수에 가장 중요한 역할을 하는 기관으로서 엽면적 및 군락 피복 정도에 따른 수광태세는 작물이 광을 얼마나 효율적으로 흡수할 수 있는지를 결정한다. 벼의 경우, 단위면적당 엽면적이 증가할수록 수량구성요소도 함께 증가하는데(Hashimoto et al., 2023), 이는 벼의 엽면적이 수량에 직접적인 영향을 미칠 수 있는 주요 형질임을 나타낸다.

벼의 엽면적을 조사하는 방법으로는 파괴적인 엽면적 조사방법과 비파괴적인 조사방법이 존재한다. 파괴적으로 엽면적을 조사하는 방법은 실제 조사하려는 주의 모든 잎의 면적을 스캔하여 엽면적을 측정하므로 시간과 노동력이 많이 소요된다는 단점이 있다. 비파괴적인 조사 방법으로는 Plant canopy analyzer와 Line quantum sensor 등의 장비를 이용하며, 이들 장비는 광합성 유효복사(Photosynthetically Active Radiation, PAR)를 기반으로 입사광과 투과광의 비율을 분석하여 엽면적지수(Leaf Area Index, LAI)를 측정한다. 하지만 측정을 위해 고가의 장비가 필요하며, 기상 환경에 따라 정확도에 영향을 받는 문제가 있다(Bréda, 2003; Hicks & Lascano, 1995; Malone et al., 2002).

최근 영상 분석 기술의 발전으로 인해 RGB 이미지로부터 다양한 작물 형질을 빠르고 정확하게 추정하고자 하는 연구가 많이 진행되고 있다. RGB 이미지는 세 가지 색상 채널을 이용해 이미지를 표현하는데 상대적으로 저렴하고 쉽게 접근할 수 있는 장비를 통해 데이터를 획득할 수 있다는 장점이 있다(Liu & Pattey, 2010). 특히 R, G, B 세 가지 색상채널의 조합으로 산출되는 여러 생육지수(Vegetation Indices, VI)는 식물체의 엽록소 함량이나 질소상태 등 작물의 생육상태를 확인하는 것 이외에도, 영상 데이터에서 작물의 녹색영역을 분리하는 데에 사용되어 엽면적을 추정하는 방법으로도 사용되고 있다(Hamuda et al., 2016; Netto et al., 2018; Lee et al., 2020).

또한 기계학습(Machine Learning) 기술은 영상 데이터를 활용하여 작물 생육 상태를 분석하고 분류하는 데 효과적인 도구로 각광받고 있다. 기계학습 기반 방법은 RGB 이미지에서 객체를 레이블링(Labeling)한 데이터를 학습 데이터로 활용하여 작물과 배경을 효율적으로 분리할 수 있도록 설계되었으며 모델이 새로운 데이터를 자동으로 분류하고 분석할 수 있도록 한다. Li et al. (2023)는 Random Forest (RF), Simple Nonlinear Regression, CatBoost 등 다양한 기계학습 모델을 적용하여 RGB 이미지에서 콩 잎을 높은 정확도로 분류하였으며, 기계학습 모델이 작물의 엽면적 추정에 유용하게 적용될 수 있음을 보여주었다. Okyere et al. (2023)는 기계학습 모델(Multi-Layer Perceptron, Support Vector Machine, RF)과 생육지수(ExG 및 ExGR)에 기반하여 이미지에서 밀과 동부콩 식물체를 분류하였다. 성능을 비교한 결과, 기계학습 모델이 생육지수 기반 방식보다 더 높은 정확도로 식물체를 분류함을 확인하였다.

본 연구에서는 벼 포장에서 직하방으로 촬영한 RGB 이미지로부터 RGB 픽셀 값과 여러 생육지수에 기반하여 식물체를 분류하였고, 다양한 기계학습 모델을 이용하여 벼 엽면적지수를 추정하고자 하였다. 농촌 인구의 감소 및 고령화에 따라 노동력을 절감할 수 있는 재배 기술의 중요성이 더욱 증가하고 있으며, 본 연구를 통해 기존 생육조사 방식의 디지털 전환으로 더욱 빠르고 효율적인 작물 생육 계측이 가능할 것으로 기대된다.

재료 및 방법

시험 포장 환경 및 엽면적 측정

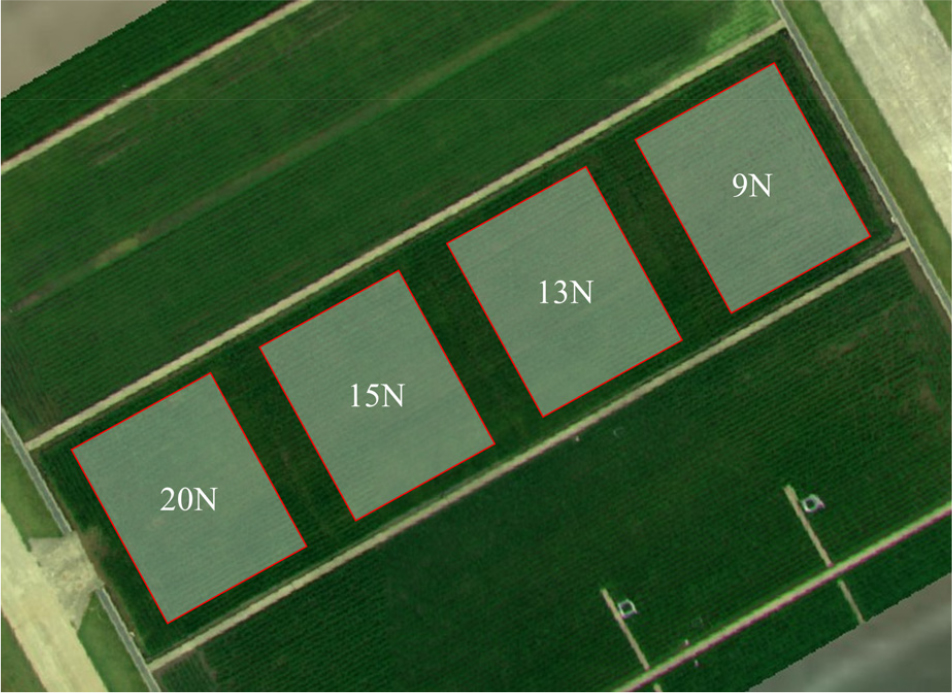

본 연구는 영상 데이터를 활용한 엽면적지수 분석을 목적으로, 2024년 5월부터 국립식량과학원 시험포장(35° 84' 34" N, 127° 04' 84" E)에서 수행되었다. 시험 품종은 중만생종인 신동진과 참동진을 사용하였고, 5월 31일에 24일 된 모를 1주당 3본씩 이앙하였다. 비료시비는 농촌진흥청 표준재배법(RDA, 2014)에 따라 밑거름으로 일시에 시비하였다. 질소 비료는 엽면적의 차이를 보기 위해 10 a당 9 kg, 13 kg, 15 kg, 20 kg로 시험구별 처리를 다르게 하여 시비하였고 기비, 분얼비, 수비를 5:3:2 비율로 나누어 분시하였다(Fig. 1). 영상 데이터로 엽면적지수를 분석할 경우 재식거리의 영향을 받기 때문에, 모든 조건에서 재식거리를 30 × 14 cm로 통일하였다.

시험구는 1 m2 면적의 16개 시험구에서 수행되었고, 각 생육 단계별로 분얼기(07/11, 07/17, 07/25), 유수형성기(07/31, 08/07, 08/13)로 구분하였다. 해당 시기에 RGB 영상을 촬영하였고, LAI-2000 (LI-COR, USA)을 사용하여 엽면적지수를 측정하였다. 엽면적지수는 군락 상부에서 입사광을 2회 반복 측정한 후 하부 군락에서 15회 반복 측정을 실시하고 다시 군락 상부에서 입사광을 2회 반복 측정하여 1회 반복 값을 산출하였으며, 시험구당 3반복으로 측정하여 데이터를 확보하였다. 추가로 실제 주당 엽면적을 확인하기 위해 시험구 내에서 대표성이 있는 4주를 수확하였고 LI-3100 (LI-COR, USA)을 이용하여 파괴적인 방법으로 엽면적을 측정하였다. 이러한 과정을 통해 영상 데이터로부터 추정한 엽면적지수와 실측 엽면적 및 엽면적지수 간의 관계를 정밀히 분석하였다.

영상 데이터 수집 및 전처리

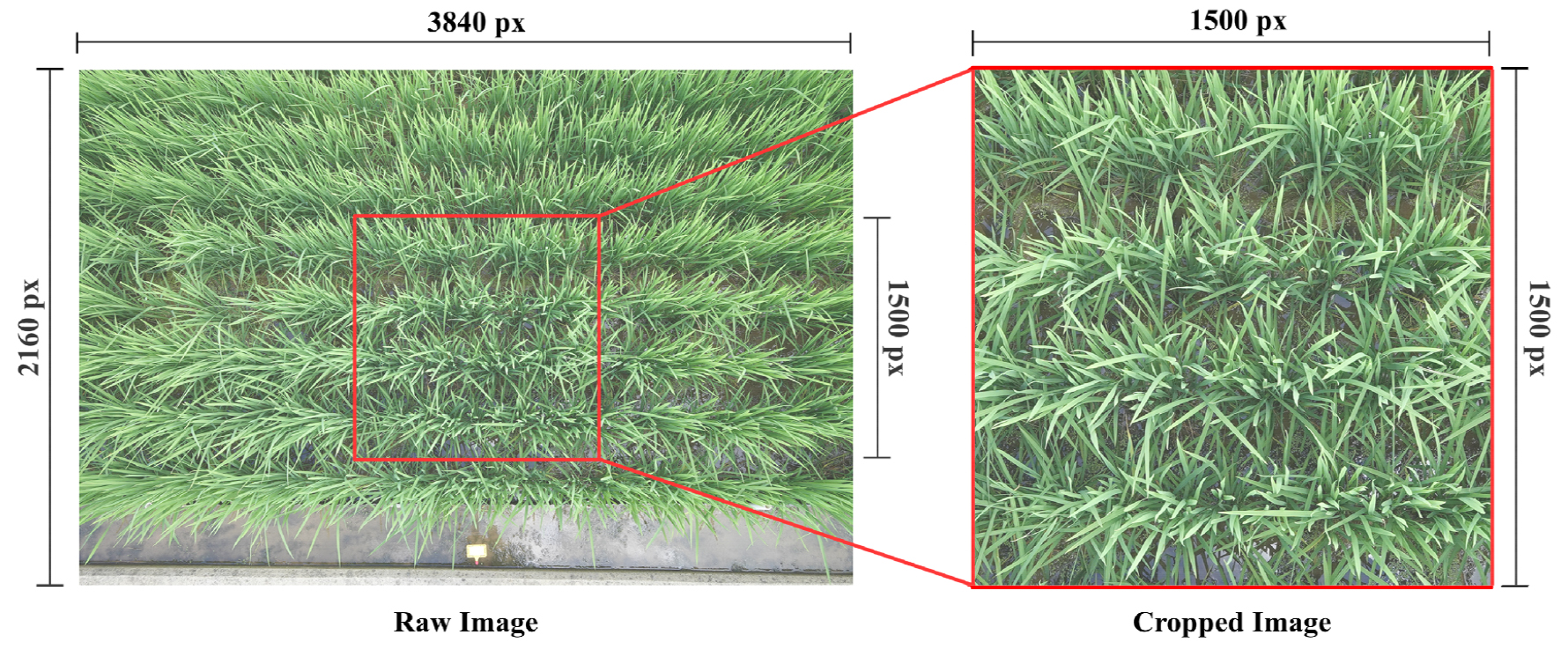

RGB 영상 데이터 수집을 위해 디지털 카메라(DSC- RXC100-M3, Japan)를 사용하였다. 촬영은 실측 엽면적 및 엽면적지수를 조사한 시험구의 중심부를 이미지의 중앙에 위치시키고, 3미터 높이에서 지면과 수직이 되도록 직하방으로 촬영하였다. 촬영된 이미지는 JPG 형식으로 저장되었으며, 해상도는 3840 × 2160 크기로 저장하였다. 촬영된 원본 이미지에서는 중심부에서 멀어질수록 촬영 화각으로 인한 왜곡이 발생하게 되는데, 이러한 왜곡을 최소화하기 위해 Python의 OpenCV 라이브러리를 활용하여 이미지 중심부를 기준으로 1500 × 1500 크기의 ROI (Region of Interest)를 설정하였다(Fig. 2). 이를 통해 분석의 정확도를 높이고, 왜곡 영향을 최소화하였다.

RGB 기반 생육지수 분석

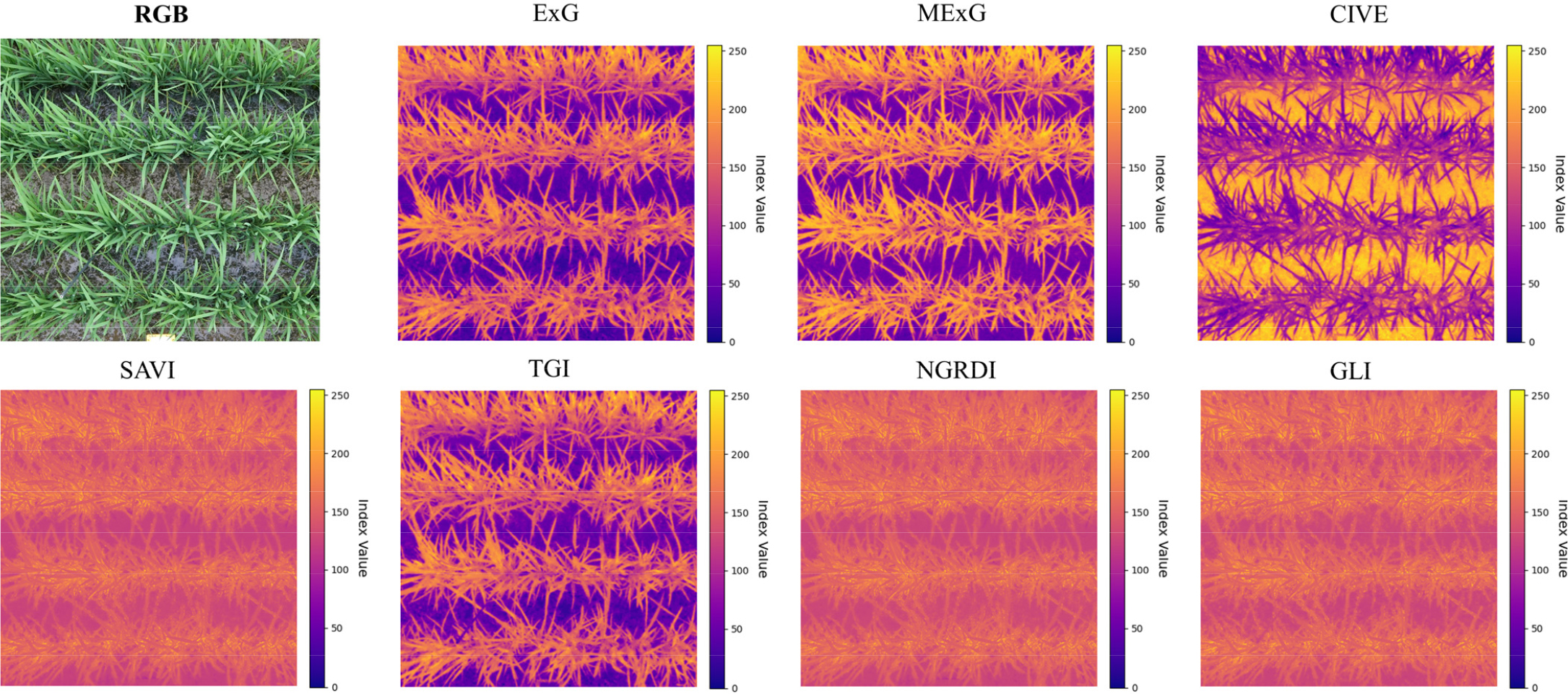

전처리한 영상 데이터에서 추출한 RGB 데이터를 활용하여, 생육지수를 계산하고 분석하였다. RGB 기반 생육지수는 각 픽셀의 R, G, B 세 가지 채널 값을 조합하여 계산하기 때문에 3채널 데이터를 1채널의 단일 지표로 변환하였다. 본 연구에서는 RGB 각 채널의 조합을 활용하여 계산되는 총 7가지 생육지수를 사용하였다. 변환에 사용된 주요 생육지수와 수식은 Table 1에 제시하였다. 생육지수의 추출을 위해 Python의 Matplotlib 패키지를 사용하여 각 픽셀의 R, G, B 값을 1차원 데이터로 변환하는 코드를 작성하여 계산하였고 이미지로 시각화 하였다(Fig. 3).

Table 1.

Summary of the vegetation indices (VI) used in this study.

| Vegetation Index (VI) | Formula | Reference |

| Excess green index (ExG) | 2g-r-b | Woebbecke et al., 1995 |

| Modified normalized green index (MExG) | 1.262g-0.884r-0.331b | Burgos-Artizzu et al., 2011 |

| Color index of vegetation extraction (CIVE) | 0.441r-0.811g+0.385b+18.7874 | Kataoka et al., 2003 |

| Green leaf index (GLI) | (2g-b-r)/(2g+b+r) | Louhaichi et al., 2001 |

| Normalized green-red difference index (NGRDI) | (g-r)/(g+r) | Gitelson et al., 2002 |

| Triangular greenness index (TGI) | g-0.39r-0.61b | Hunt et al., 2013 |

| Soil-adjusted vegetation index (SAVI) | 1.5(g-r)/(g+r+0.5) | Huete, 1988 |

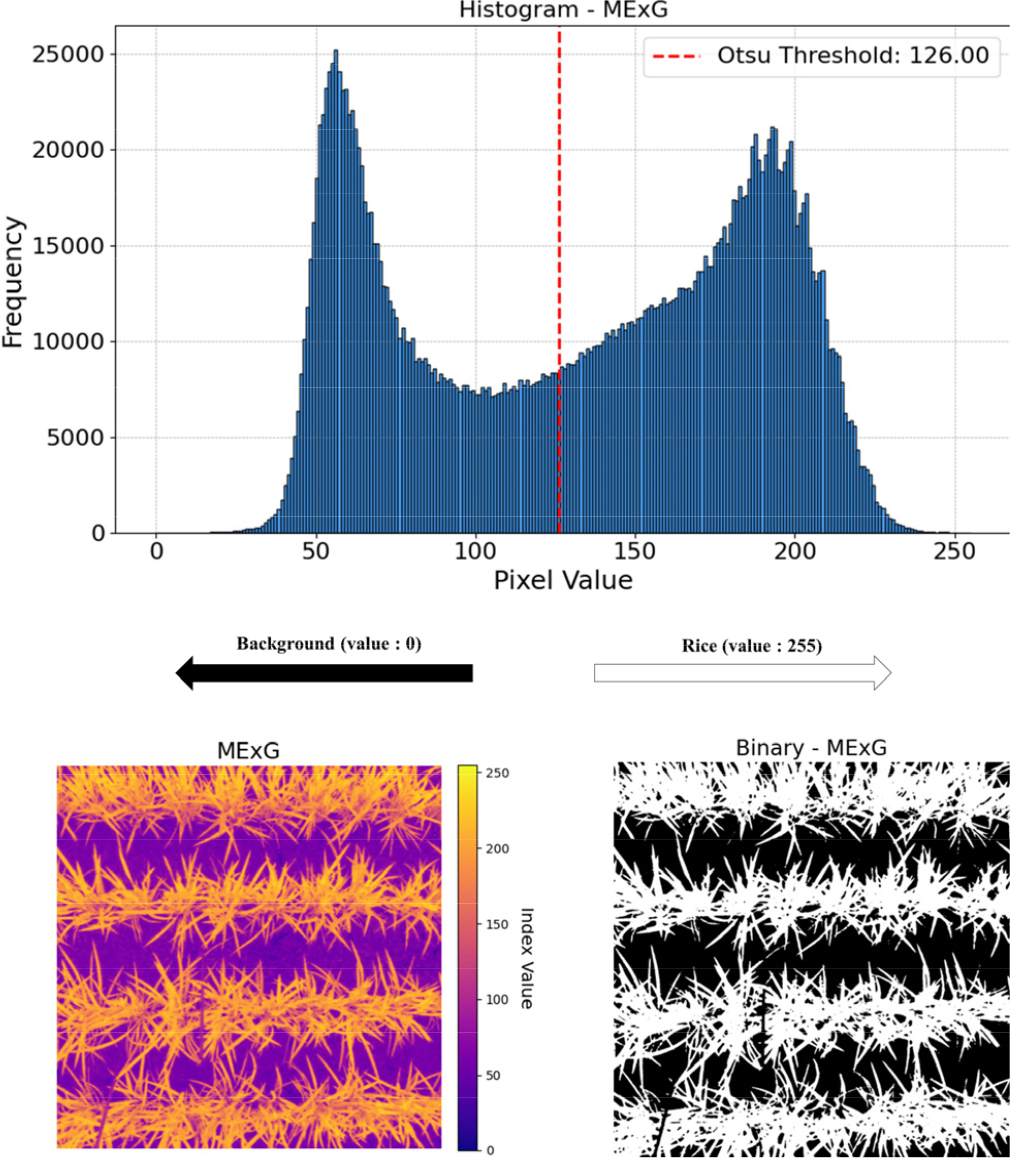

7가지 생육지수 기반 이미지로부터 군락 피복을 대표할 수 있는 이진 이미지(Binary image)를 작성하기 위해, 최적의 임계 값을 자동으로 찾을 수 있는 오츠 알고리즘(Otsu’s method)을 이용하였다. 오츠 알고리즘은 1979년 제안된 이미지 이진화 기법으로, 이미지의 히스토그램을 분석하여 최적의 임계 값을 결정하는 알고리즘이다(Otsu, 1979). 무작위로 추출한 픽셀 값을 토대로 각 생육지수별로 식물체와 배경을 나눌 수 있는 임계 값을 지정하였으며, 0에서 255 픽셀 값 사이에서 임계 값 이하의 픽셀과 임계 값 이상의 픽셀을 나누어 식물과 배경으로 분류하였고, 이진 이미지를 생성하였다(Fig. 4).

Fig. 4.

Example of Otsu’s threshold segmentation using the MExG index. The top panel presents the pixel-value histogram of the MExG image, with the computed Otsu threshold (red dashed line) at 126.00. The bottom panels illustrate the color-index (MExG) image (left) and the corresponding binary image (right) generated by applying the Otsu threshold to separate the rice canopy (white) from the background (black).

기계학습 모델 데이터 구성 및 전처리

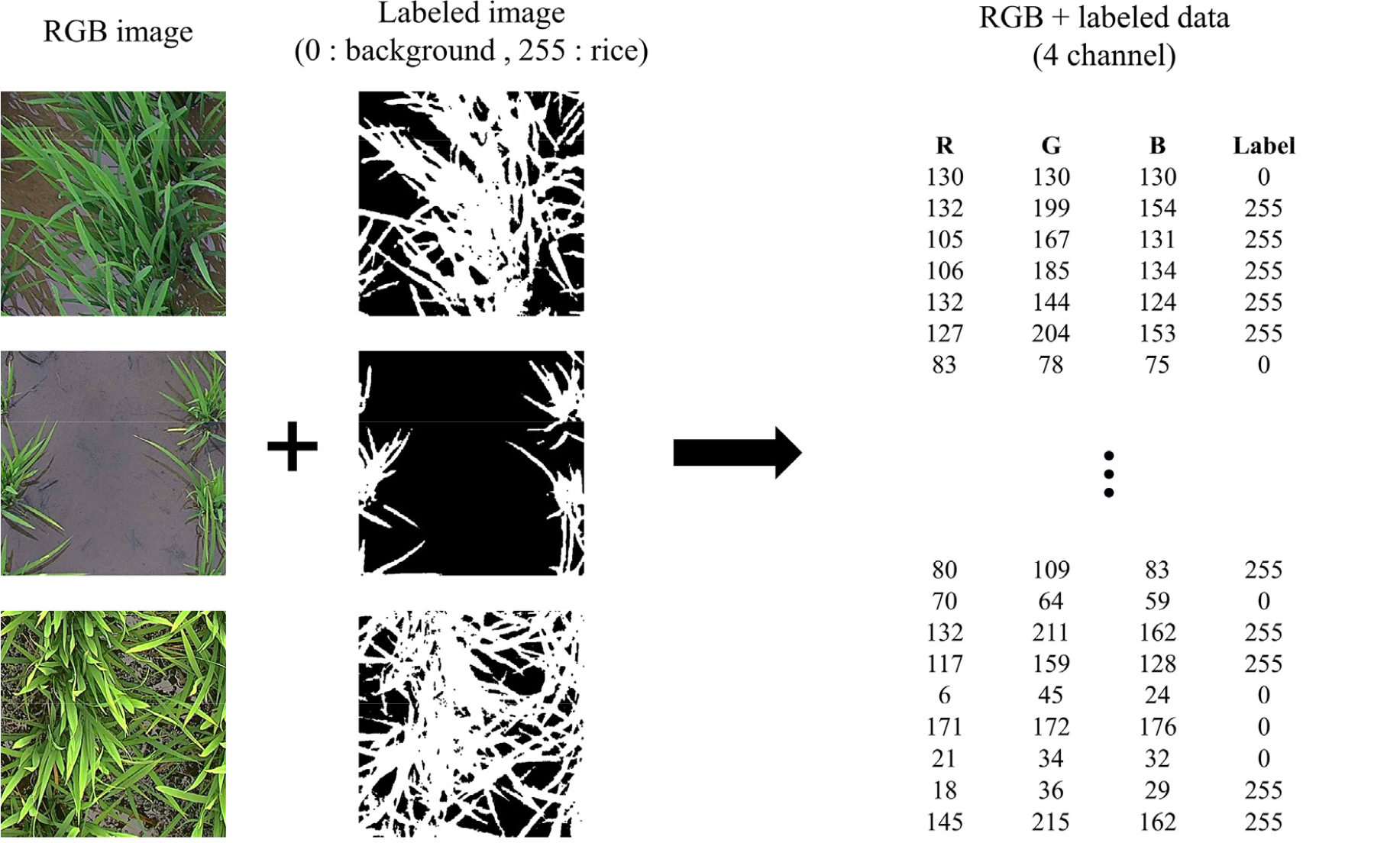

영상 데이터로부터 엽면적지수를 추정하기 위해 이미지의 각 픽셀 RGB 값을 입력 변수로 사용하여 벼 부분을 학습하고 예측하는 모델을 구축하였다. 모델 학습을 위해 원본 이미지에서 벼 부분만을 추출하여 픽셀 값을 255(식물)와 0(배경)으로 구분한 데이터인 이진 이미지를 생성하였다. 보다 정확한 RGB 정보를 학습 데이터로 활용하기 위해 사람이 직접 레이블링한 데이터를 사용하였다. 학습에 사용한 데이터셋은 512 × 512 크기의 RGB 원본 이미지와 해당 이진 이미지가 각각 3,820장씩 포함되었다. 기계학습 모델 구축을 위해 각 픽셀의 R, G, B 값과 이진 이미지의 라벨 값을 결합하여 4개 채널의 데이터로 변환하였으며, RGB 값을 독립 변수(Feature), 이진 이미지의 값을 종속 변수(label)로 설정하여 학습을 진행하였다(Fig. 5). 또한, 모델의 일반화 성능을 검증하기 위해 데이터를 학습(Training) 데이터와 평가(Test) 데이터로 7:3 비율로 분리하여 학습 데이터에 사용하지 않은 데이터로 검증하였다.

Fig. 5.

Data generation for machine learning. The left and middle columns show original top-down photographs of the rice canopy and threshold-based binary images distinguishing the plants (white) from the background (black), respectively. The tables on the right list pixel-level R, G, and B values with their corresponding labels (255 = plant; 0 = background).

기계학습 모델 구축 및 평가

본 연구에서는 영상 데이터로부터 벼 엽면적지수를 측정하기 위해 다양한 기계학습 알고리즘을 활용하여 벼 부분과 배경을 정확히 분류하고, 벼 부분의 RGB 특성을 학습하는 모델을 구축하였다. 트리 기반 모델(RF, Gradient Boosting, eXtreme Gradient Boosting, Light Gradient Boosting Machine)은 데이터의 비선형적 특성을 효과적으로 학습한다. eXtreme Gradient Boosting (XGB)와 Light Gradient Boosting Machine (LGBM)은 학습 속도와 과적합 방지 측면에서 성능을 개선한 모델이다(Breiman, 2001; Chen & Guestrin, 2016; Friedman, 2001; Ke et al., 2017). Support Vector Machine (SVM)은 초평면을 활용하여 고차원에서 효과적인 분류 성능을 가진다(Tang, 2013). 신경망 모델인 MLPClassifier (MLPC)는 다층 퍼셉트론 구조를 통해 비선형 관계를 학습한다(Taylor et al., 2005). 각 모델의 성능을 최적화하기 위해 그리드 서치(Grid Search)를 활용하여 하이퍼파라미터를 조정하였다(Table 2).

Table 2.

Machine learning models and their optimized hyperparameters.

모델 평가는 학습 데이터셋과 분리된 평가 데이터셋의 이미지에서 수행되었고, 각각의 이미지에서 기계학습 모델이 벼 잎으로 분류한 픽셀과 배경으로 분류한 픽셀을 정확도(Accuracy), 정밀도(Precision), 재현율(Recall), F1 스코어(F1 score)로 평가하였다(식 (1), (2), (3), (4)).

여기서 TP, TN, FP, FN은 각각 참 양성(True Positive), 참 음성(True Negative), 거짓 양성(False Positive), 거짓 음성(False Negative)을 의미한다.

RGB 기반 생육지수와 기계학습 모델을 활용한 엽면적지수 평가

영상 데이터로부터 추정한 엽면적지수의 정확도를 평가하기 위해 앞서 추출한 생육지수 및 기계학습 모델을 기반으로 예측된 값과 실제 엽면적지수 및 파괴적으로 조사된 엽면적의 상관관계를 생육 단계별로 비교 분석하였다. 평가 지표로는 결정계수(R2), Root Mean Square Error (RMSE), Normalized Root Mean Square Error (NRMSE), Mean Absolute Error (MAE)를 사용하였으며(식 (5), (6), (7)), 평가는 Python의 Scikit-learn 패키지를 사용하여 도출하였고 Matplotlib을 사용하여 시각화 하였다.

여기서 는 추정 값, 는 측정 값, 그리고 는 측정 값들의 평균 값을 나타낸다. 본 수식을 사용하여 생육지수에서 추출된 값과 기계학습 모델에서 도출된 영상 기반 엽면적지수를 센서 기반 엽면적지수 및 파괴적으로 측정한 엽면적과 정량적으로 평가하였다.

결과 및 고찰

엽면적 및 엽면적지수 시계열 변화

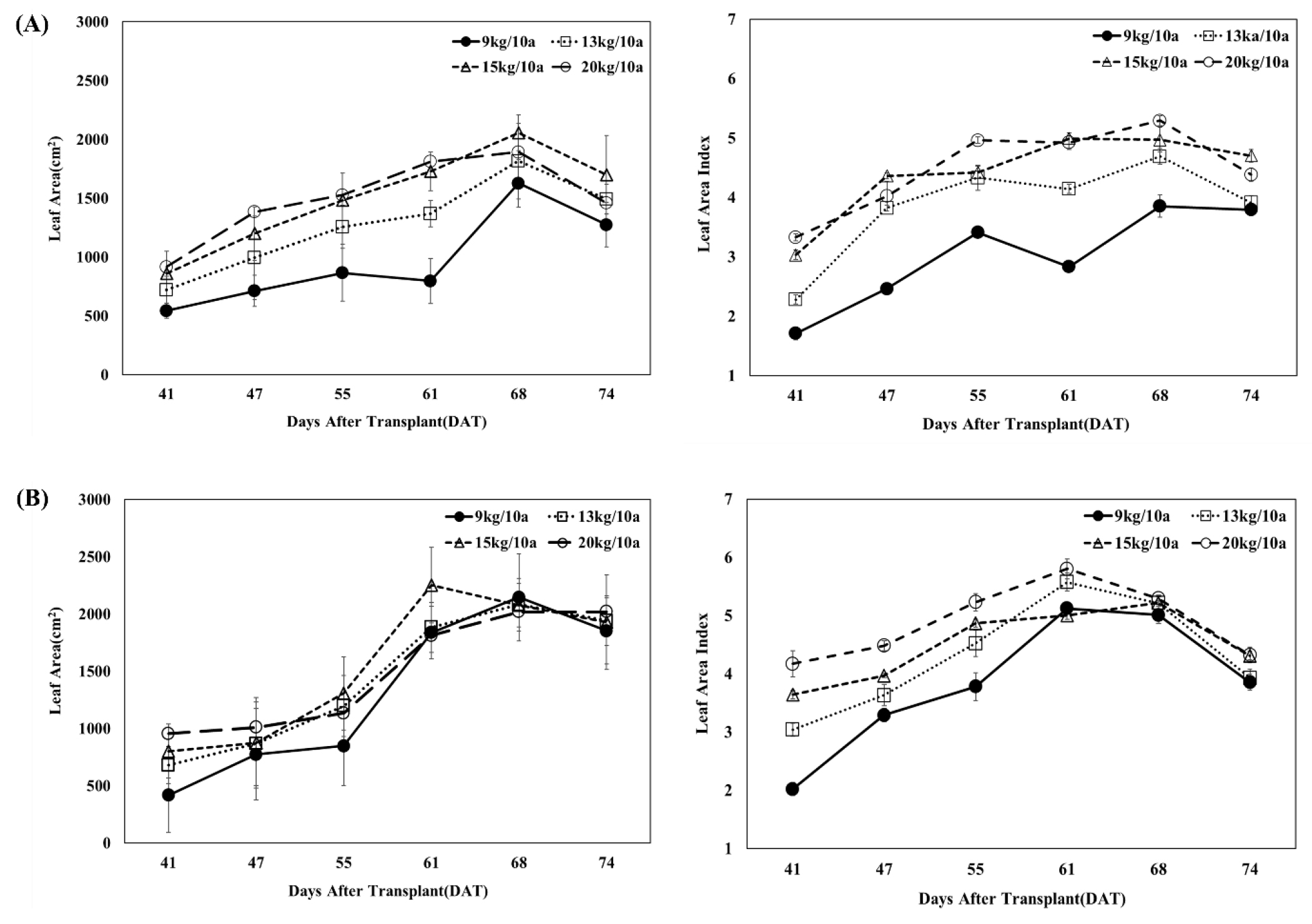

분얼기에서 유수형성기 단계인 이앙 후 41일부터 74일까지 파괴적으로 조사한 엽면적 및 센서 기반 엽면적지수의 시계열상 변화를 분석하였다(Fig. 6). 그 결과, 모든 조건에서 질소 시비량이 증가할수록 엽면적이 증가하는 경향을 보여 기존에 보고된 선행 연구 결과와 일치하였다(Knops and Reinhart, 2000). 파괴적으로 조사한 엽면적은 두 품종 모두 시간에 따라 증가하다가 이앙 후 68일에 가장 큰 값을 보이고 이후 감소하는 경향을 보였다. 센서 기반 엽면적지수는 참동진에서 이앙 후 68일에 가장 큰 값을 보여 파괴적으로 조사한 엽면적과 비슷한 경향이었고, 신동진의 경우 참동진보다 조금 더 이른 이앙 후 61일에 가장 큰 값을 나타냈다. 또한 파괴적으로 측정한 엽면적과 센서 기반 엽면적지수 모두 이앙 후 61일까지는 빠르게 증가하고, 이앙 후 68일, 74일에는 느리게 증가하거나 정체 또는 감소하는 경향을 보여 생육시기에 따른 엽면적의 시계열상 변화를 확인하였다.

기계학습 모델 학습 결과 및 평가

기계학습 모델을 이용하여 영상 데이터로부터 벼 엽면적지수를 추정하기 위해 시기별 데이터셋으로 학습한 총 6가지 기계학습 모델의 성능을 평가하였다(Table 3). 전체 예측 중 맞힌 것의 비율인 정확도, 모델이 참이라고 예측한 것 중 실제로 참인 것의 비율인 정밀도, 실제 참인 것 중에서 모델이 참이라고 예측한 것의 비율인 재현율, 정밀도와 재현율의 조화평균인 F1-score 지표로 모델 성능을 평가하였다. 그 결과, RF 모델과 XGB 모델이 0.9839로 가장 높은 정확도를 나타냈고, 0.9768로 가장 높은 F1-score 값을 보였다. 정밀도는 RF 모델이 0.9805로 가장 높았으며, 재현율은 Gradient Boosting(GB)이 0.9738로 가장 높은 값을 보였다. 특히 모든 모델에서 0.97 이상의 높은 픽셀 정확도, 정밀도, 재현율, F1-score를 나타내었는데, 기계학습 모델이 RGB 픽셀 값을 이용하여 효과적으로 식물체와 배경을 분류한 결과로 판단된다.

Table 3.

Classification performance of machine learning models in terms of accuracy, precision, recall, and F1-score.

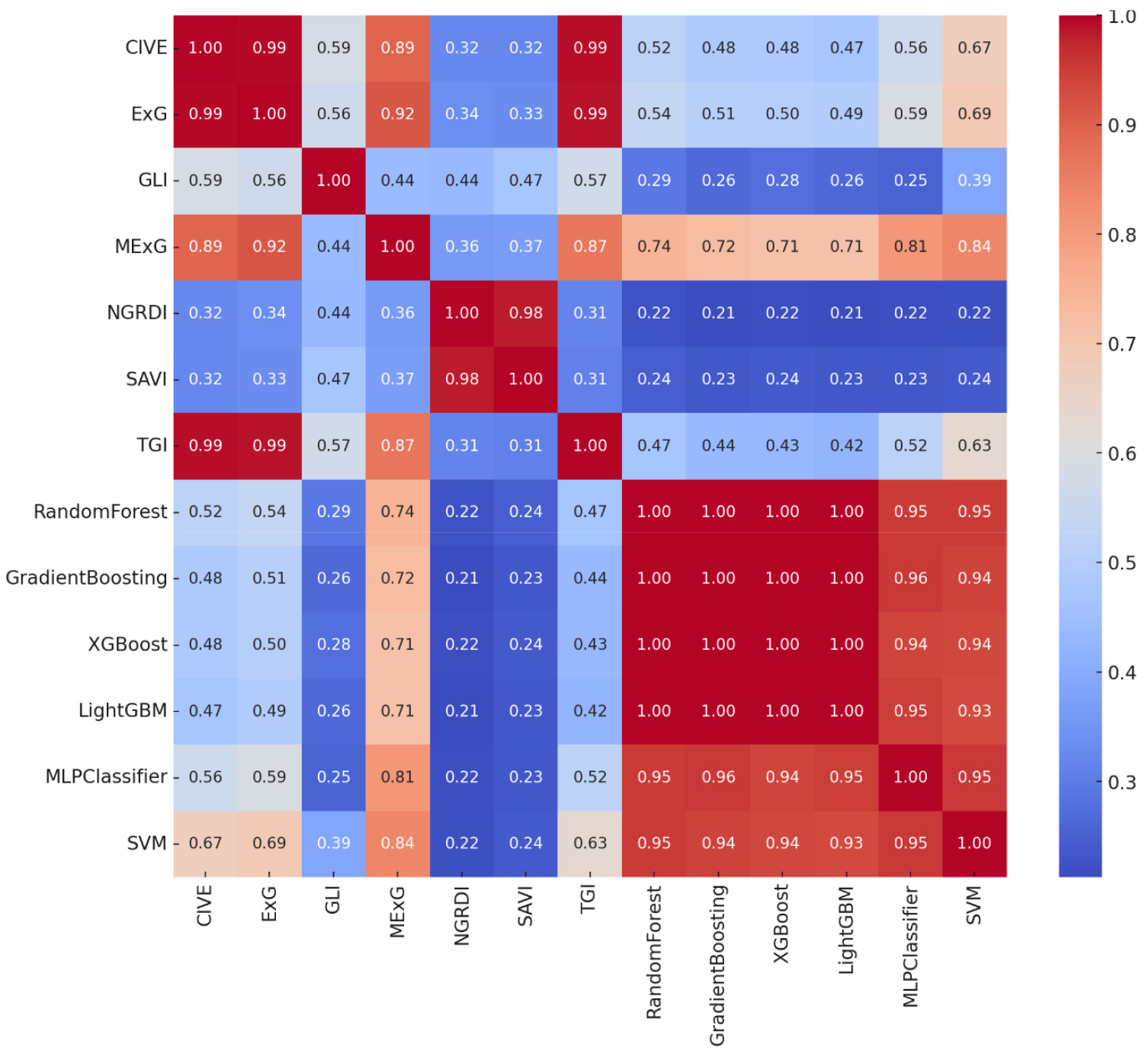

생육지수 및 기계학습 모델 간 상관관계 분석

7가지 생육지수와 6가지 기계학습 모델 간의 상관관계를 분석하기 위해 결정계수(R2)를 기반으로 히트맵을 작성하였다(Fig. 7). 먼저 RGB 기반 생육지수 간 상관관계에서 CIVE와 ExG, TGI 간에 0.99의 매우 높은 상관관계를 확인하였고, NGRDI와 SAVI 간에도 0.98의 높은 상관성을 보여 이들 지수가 벼의 녹색 정도를 측정하는 데 있어 유사한 패턴을 보이는 것으로 판단된다. MExG는 CIVE (0.89), ExG (0.92), TGI (0.87)와 높은 상관관계를 보였으며, 특히 MLPC (0.81)와 SVM (0.84)과도 높은 상관성을 나타내 생육지수 중 기계학습 모델과 가장 강한 연관성을 보이는 지수임을 확인하였다.

Fig. 7.

R2 heatmap illustrating the determination coefficient among seven vegetation indices (CIVE, ExG, GLI, MExG, NGRDI, SAVI, and TGI) and seven machine learning models (RandomForest, GradientBoosting, XGBoost, LightGBM, MLPClassifier, and SVM). The color scale represents low-to-high (blue-to-red) R2 values, indicating how well the predictions of each model align with each vegetation index.

기계학습 모델 간 상관관계를 분석한 결과 RF, GB, XGB, LGBM 모델들 간에 매우 높은 상관관계가 확인되었고, 이는 네 가지 모델이 유사한 학습 패턴으로 엽면적지수를 추정하는 것으로 시사된다. 특히 SVM은 기계학습 모델 중 생육지수와의 상관성이 가장 높았으며, MExG (0.84), ExG (0.69), CIVE (0.67), TGI (0.63)와 높은 상관관계를 보였다. 이는 SVM이 생육지수를 활용하는 방식에서 다른 모델과 차이를 보일 가능성이 있으며, 특정 생육지수와 강한 연관성을 가진 특징을 학습했다고 판단된다. 또한, MLPC (SVM과 0.95의 높은 상관관계)와 트리 기반 모델들(XGB, GB, LGBM)의 패턴 차이를 고려할 때, 학습 알고리즘마다 생육지수와 상호작용하는 방식이 다른 것으로 생각된다. 이러한 분석을 바탕으로, 기계학습 모델을 활용하여 엽면적지수를 추정할 때 생육지수 활용 방식에 따라 모델 선택을 다르게 접근할 필요가 있을 것으로 보인다.

생육지수 및 기계학습 모델 기반 엽면적지수 평가

생육지수 및 기계학습 모델을 이용하여 영상 데이터로부터 벼 엽면적지수를 추정하였으며, 이를 파괴적으로 측정한 엽면적과 센서를 이용하여 측정한 엽면적지수와 비교하여 평가하였다. 모델 성능 평가를 위해 결정계수(R2), RMSE, NRMSE, MAE 4가지 지표를 사용하여 정확도를 분석하였다. 전체 생육 시기(분얼기 및 유수형성기) 영상 데이터를 활용하여 모델이 추정한 엽면적지수와 실측 엽면적 및 엽면적지수 간의 상관관계를 비교한 결과, 생육지수 중에서는 ExG가 가장 높은 R2 값을 보여 실측 엽면적과 가장 가깝게 추정하는 것으로 나타났다(Table 4). 기계학습 모델의 경우, SVM이 가장 낮은 예측 성능을 보였으며 나머지 모델들은 유사한 성능을 나타냈다. 또한 파괴적으로 측정한 엽면적 대신 센서 기반 엽면적지수를 실측 값으로 사용했을 때 예측 성능이 더 높아지는 경향을 보였으며, 이는 영상 데이터를 이용한 엽면적지수 분석에 센서 기반 엽면적지수가 파괴적으로 측정한 엽면적보다 추정에 적합한 지표일 가능성을 시사한다. 그러나 전체 생육 시기 데이터를 사용하여 분석했을 때 모든 모델에서 대체적으로 낮은 R2 값을 보였으며, 정확한 엽면적지수 추정을 위해 시기별 분석이 필요하였다. 이에 따라 분얼기와 유수형성기 데이터를 개별적으로 분석하여 정확도를 비교하였다.

Table 4.

Performance metrics (R2, RMSE, NRMSE, and MAE) of vegetation indices and machine learning models for leaf area and LAI across the entire growth period.

분얼기와 유수형성기 시기별 엽면적지수 분석

분얼기(07/11~07/25) 영상 데이터만을 사용하여 엽면적지수를 추정한 결과, 전체 생육 시기 데이터를 활용했을 때보다 정확도가 향상되었다(Table 5). 이는 생육시기 중 분얼기까지는 직하방 RGB 영상에서 배경과 식물체를 효과적으로 분류할 수 있어 엽면적지수를 정확히 추정할 수 있는 것으로 판단된다. 특히 생육지수에서는 MExG가 가장 높은 상관관계를 보여 실측 엽면적과 가장 가깝게 엽면적지수를 추정하는 것으로 나타났으며, CIVE, ExG, TGI 역시 실측 엽면적과 높은 상관성을 보였다. 기계학습 모델을 활용하여 분석한 결과, 트리 기반 모델(RF, GB, XGB, LGBM)이 가장 우수한 예측 성능을 보여 다른 모델보다 분류 패턴을 효과적으로 학습한 것으로 판단된다. 특히 모든 기계학습 모델이 생육지수보다 엽면적지수를 더욱 정확하게 추정하였는데, 생육지수는 RGB 값의 선형적인 조합으로 식물체와 배경을 분류하지만 기계학습 모델은 RGB 값 간의 비선형 패턴까지 학습하므로 더 정밀하게 엽면적지수를 추정하는 것으로 판단된다.

Table 5.

Performance metrics (R2, RMSE, NRMSE, and MAE) of vegetation indices and machine learning models for leaf area and LAI during the tillering stage.

유수형성기 이후(07/31~08/13) 데이터만을 사용하여 엽면적지수를 추정한 결과, 정확도가 크게 감소하는 경향을 보였다(Table 6). 특히 생육지수를 활용한 방법과 기계학습 모델 모두에서 R2 값이 낮아지는 경향이 확인되었으며, 이는 후기 생육 단계에 잎이 서로 겹치는 부분이 많아지면서 RGB 영상 데이터만으로 피복도를 정확히 추정하는 데 한계가 있음을 시사한다. 또한 유수형성기 이후에는 센서를 이용하여 측정한 엽면적지수보다 파괴적으로 측정한 엽면적을 실측 값으로 사용할 때 예측 성능이 향상되는 경향이 나타났다. 이는 이 시기 이후 분얼수 및 엽수의 증가가 멈추고, 주로 엽장 증가로 인해 엽면적이 증가하기 때문으로 판단된다. 따라서 후기 생육 단계에서는 센서 기반 엽면적지수가 엽장 변화를 충분히 반영하지 못할 가능성이 있으며, 유수형성기 이후의 엽면적지수를 추정할 때는 파괴적으로 측정한 엽면적 실측 값이 더 적합할 수 있다. 보다 다양한 포장 환경에서 얻은 이미지 데이터 셋으로 모델을 학습한다면 추정 정확도를 더욱 높일 수 있을 것으로 판단되며, 딥러닝 기반 이미지 분류 모델을 이용하여 추후 연구를 수행한다면 영상 데이터로부터 더욱 정확하게 엽면적지수를 측정할 수 있을 것으로 사료된다.

Table 6.

Performance metrics (R2, RMSE, NRMSE, and MAE) of vegetation indices and machine learning models for leaf area and LAI after panicle initiation.

적 요

벼 엽면적은 광합성과 수량에 밀접하게 연관된 중요한 생육 지표이지만, 기존의 파괴적 조사 방법은 노동력과 시간이 많이 소요되고, 센서를 이용한 방법은 기상 환경에 따른 제약이 있다. 이에 본 연구에서는 중만생종 벼를 분얼기부터 유수형성기까지 직하방으로 촬영한 RGB 이미지를 활용하여 엽면적지수를 정밀하게 추정하고자 하였다. RGB 채널 정보를 결합하여 계산되는 7가지 생육지수를 기반으로 오츠 알고리즘을 이용해 배경과 식물체를 분리하였고, 엽면적지수 추정을 위해 6가지 기계학습 모델을 작성하였다. 모델 성능을 평가한 결과 모든 기계학습 모델이 0.98 이상의 정확도를 보였고, 시기별로 생육지수와 기계학습 모델을 이용하여 엽면적지수를 추정한 결과 분얼기에는 생육지수 MExG, CIVE, ExG, 기계학습 모델에서는 RF, GB, XGB, LGBM이 실제 파괴적으로 측정한 엽면적 및 센서 기반 엽면적지수와 높은 상관관계를 보였다. 반면 유수형성기 이후에는 잎의 형태 변화와 군락 내 음영 증가로 인하여 전체적으로 정확도가 낮아지는 경향이었고, 센서를 이용하여 측정한 엽면적지수보다 파괴적으로 조사한 실제 엽면적과의 상관성이 더 높게 나타났다. 본 연구 결과를 통해 생육지수보다 기계학습 모델로 엽면적지수를 추정했을 때 실측 값과 더 가깝게 추정하는 것을 확인하였고, 영상 데이터로부터 생육 초기 벼 엽면적지수를 보다 간편하고 효율적으로 추정할 수 있을 것으로 시사된다.