서 론

재료 및 방법

영상 데이터 수집

연구 흐름 및 데이터셋 구축

분할 모델 및 학습 환경

모델 학습 및 평가 방법

결과 및 고찰

딥러닝 모델 학습 과정

분할 성능 정량 평가

방법론별 분할 결과의 시각적 비교

시계열 피복도 변화 분석

적 요

서 론

벼(Oryza sativa L.)는 세계 주요 식량 작물 중 하나로, 안정적인 작물 생산은 식량 안보에 중요한 역할을 한다. 작물 생산성에 영향을 미치는 요인 중 군락 피복도(Canopy Coverage)는 단위 면적당 잎의 비율을 나타내는 지표이며, 군락의 광합성 및 바이오매스 축적과 관련이 있어 수확량 예측에 변수로 활용된다(Bréda, 2003; Reza et al., 2019). 따라서 벼의 생육 단계별 피복도를 모니터링하는 것은 생육을 진단하고 수량 예측의 정확도를 높이는 데 도움이 될 수 있다.

기존의 피복도 측정은 작물을 직접 채취하여 분석하거나 고가의 장비를 이용하는 방식으로 이루어진다. 이러한 방법들은 시간과 노동력이 많이 소요되고, 기상 조건과 같은 외부 환경에 민감하다는 한계가 있다(Lee & Lee, 2011). 최근에는 이러한 단점을 보완하기 위해 무인항공기나 고정형 카메라로 RGB 영상을 취득하여 분석하는 기술이 농업 분야에 도입되고 있다. 특히 RGB 영상은 비교적 저비용으로 고해상도 데이터를 얻을 수 있어 작물 모니터링이나, 작물 표현형 분석에 유용한 도구로 활용되고 있다(Das Choudhury et al., 2019; Kim et al., 2025). 이러한 영상 기반 분석 기술은 정밀 농업 및 데이터 기반 육종의 흐름과 관련이 있다. 특히 신품종 개발이나 재배법 연구에서는 대규모 포장에서 여러 표현형 데이터를 반복적으로 측정하는 고효율 표현형 분석(High-throughput Phenotyping) 기술이 요구된다. 이에 따라 영상 데이터를 자동으로 처리하여 벼의 생육 정보를 정량화하는 기술의 필요성이 점차 커지고 있다.

최근에는 무인항공기 및 고해상도 RGB 영상을 활용하여 작물의 생육 지표를 보다 정밀하게 추정하려는 연구가 활발히 진행되고 있다. Zhang et al.(2024)은 벼의 엽면적지수 추정 연구에서 RGB 영상이 다분광 영상에 비해 공간 해상도가 높아 텍스처 정보를 더 효과적으로 포착할 수 있으며, 이를 결합할 때 추정 정확도가 크게 향상됨을 보고하였다. 또한, Ge et al.(2025)의 연구에서는, 다양한 공간 스케일에서의 벼 질소 농도 진단 연구를 통해, 군락 수준의 분석에서는 토양이나 물과 같은 배경 잡음을 제거하는 영상 분할(Segmentation) 과정이 모델의 성능을 결정짓는 핵심 요인임을 입증하였다. 이러한 선행 연구들은 저비용 RGB 영상만으로도 적절한 분할 기법과 특징 추출이 동반된다면 고가의 센서를 대체할 수 있는 높은 잠재력이 있음을 시사한다.

RGB 영상에서 피복도를 정량화하는 전통적인 방법 중 하나는 식생지수(Vegetation Index)를 계산하고 임계 값을 적용하여 식생과 배경을 분리하는 것이다(Woebbecke et al., 1995; Liao et al., 2018). 이 방법은 계산이 간단하지만 RGB 영상 취득 시 광 조건, 토양 상태 등에 따라 분할 정확도가 달라질 수 있는 한계를 가진다.

이러한 한계를 보완하기 위해 딥러닝 기반의 Semantic Segmentation 기술이 농업 영상 분석에 적용되고 있다. 이는 이미지를 픽셀 단위로 분류하는 기술로, U-net이나 DeepLabV3+와 같은 CNN (Convolutional Neural Network) 모델을 통해 객체의 경계를 정밀하게 인식한다. 이 기술은 벼, 옥수수 등 여러 작물의 피복도 분석에서 그 유용성이 보고된 바 있다(Ma et al., 2019; Bak et al., 2023). CNN은 이미지의 지역적 특징을 계층적으로 학습하여 복잡한 패턴을 인식하는 데 강점이 있다. 벼 군락 영상은 밀식 재배 환경에서 잎들이 서로 겹쳐 경계가 불분명하고 유사한 질감이 반복되는 특성을 가지는데, 이러한 복잡한 영상의 분할 정확도를 높이기 위해서는 다양한 CNN 아키텍처의 성능을 비교하여 최적의 모델을 탐색하는 과정이 필수적이다.

따라서 본 연구에서는 벼 군락 영상에서 피복도를 가장 효과적으로 추정하는 방법론을 탐색하고자 하였다. 이를 위해 국내 여러 지역에서 수집한 벼 군락 영상 데이터 셋을 구축하고, (1) 전통적인 식생지수 기반 방법과 (2) 다양한 CNN 기반 분할 모델의 성능을 정량적으로 비교 및 평가하였다. 본 연구는 단일 지역 및 단기 영상 분석에 한정된 선행 연구와 달리, 다양한 농업 기후대에서 수집된 대규모 시계열 RGB 영상을 활용하여 모델을 학습 및 평가했다는 점에서 차별성이 있다. 또한 고가 장비 없이 RGB 영상만으로 군락 피복도를 정확하게 추정하여 효율적이고 실용적인 영상 분석 기술을 제시하였다. 이러한 접근은 생육 정보를 자동으로 정량화 할 수 있는 기반을 제공함으로써, 정밀농업 및 디지털 육종 분야 기술 개발을 위한 기초 자료로 활용될 수 있을 것이다.

재료 및 방법

영상 데이터 수집

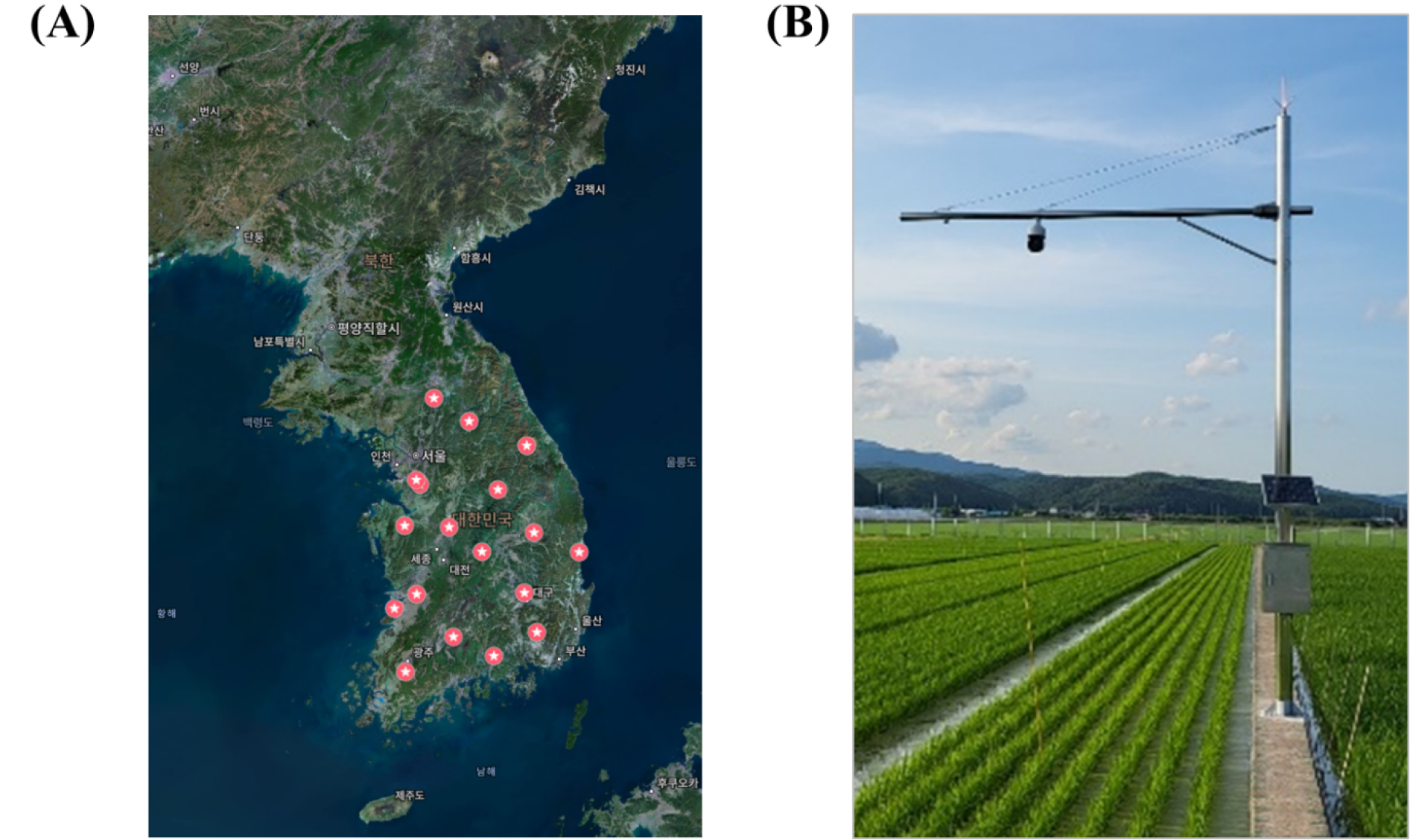

본 연구는 딥러닝 모델이 대한민국 내의 다양한 농업 환경과 품종 특성에 대해 높은 일반화 성능을 갖도록, 농업 지대를 기준으로 구분된 4개 권역, 총 18개 지역의 논에서 영상 데이터를 체계적으로 수집하였다(Fig. 1A). 데이터 수집 지역은 지형 및 재배 환경 특성에 따라 평야지(수원, 화성, 청주, 예산, 완주, 익산, 계화, 나주, 밀양, 대구, 진주), 중산간지(철원, 춘천, 안동, 상주) 그리고 산간고랭지(운봉, 진부)를 포함하여 데이터의 지리적 대표성을 확보하였다.

Fig. 1.

Data collection sites and the field camera system used in this study. (A) A map of South Korea indicating the 18 data collection sites, selected to represent diverse geographical and agricultural environments. (B) Tower-type PTZ camera system installed in rice paddies for automated, high-resolution image acquisition.

각 지역의 논에 타워형 PTZ (Pan-Tilt-Zoom) 카메라인 Hanwha Vision XNP-8300RW를 설치하였다(Fig. 1B). 카메라는 논바닥을 기준으로 5 m 높이의 기둥에 고정하였으며, 논둑이나 포장 외곽의 위치 효과 등에 따른 생육 편차를 최소화하기 위해 대표성이 있는 포장 중앙부를 촬영할 수 있도록 카메라를 설치하였다. PTZ 카메라는 초기 구도 설정에만 Pan-Tilt-Zoom 기능이 사용되었고, 이후 모든 시계열 영상은 일관된 데이터를 확보하기 위해 고정된 위치에서 직하방으로 촬영되었다. 영상 데이터는 Wisenet WAVE (Hanwha Vision, South Korea) 소프트웨어를 통해 제어되었으며, 촬영 시 광 조건의 노이즈를 최소화하기 위해 매일 오전 8시에 3,840×2,160 해상도의 RGB 영상이 자동으로 수집되도록 하였다. 영상 데이터는 Wisenet WAVE (Hanwha Vision, South Korea) 소프트웨어를 통해 제어되었으며, 촬영 시 광 조건의 노이즈를 최소화하기 위해 매일 오전 8시에 3,840×2,160 해상도의 RGB 영상이 자동으로 수집되도록 하였다.

연구 흐름 및 데이터셋 구축

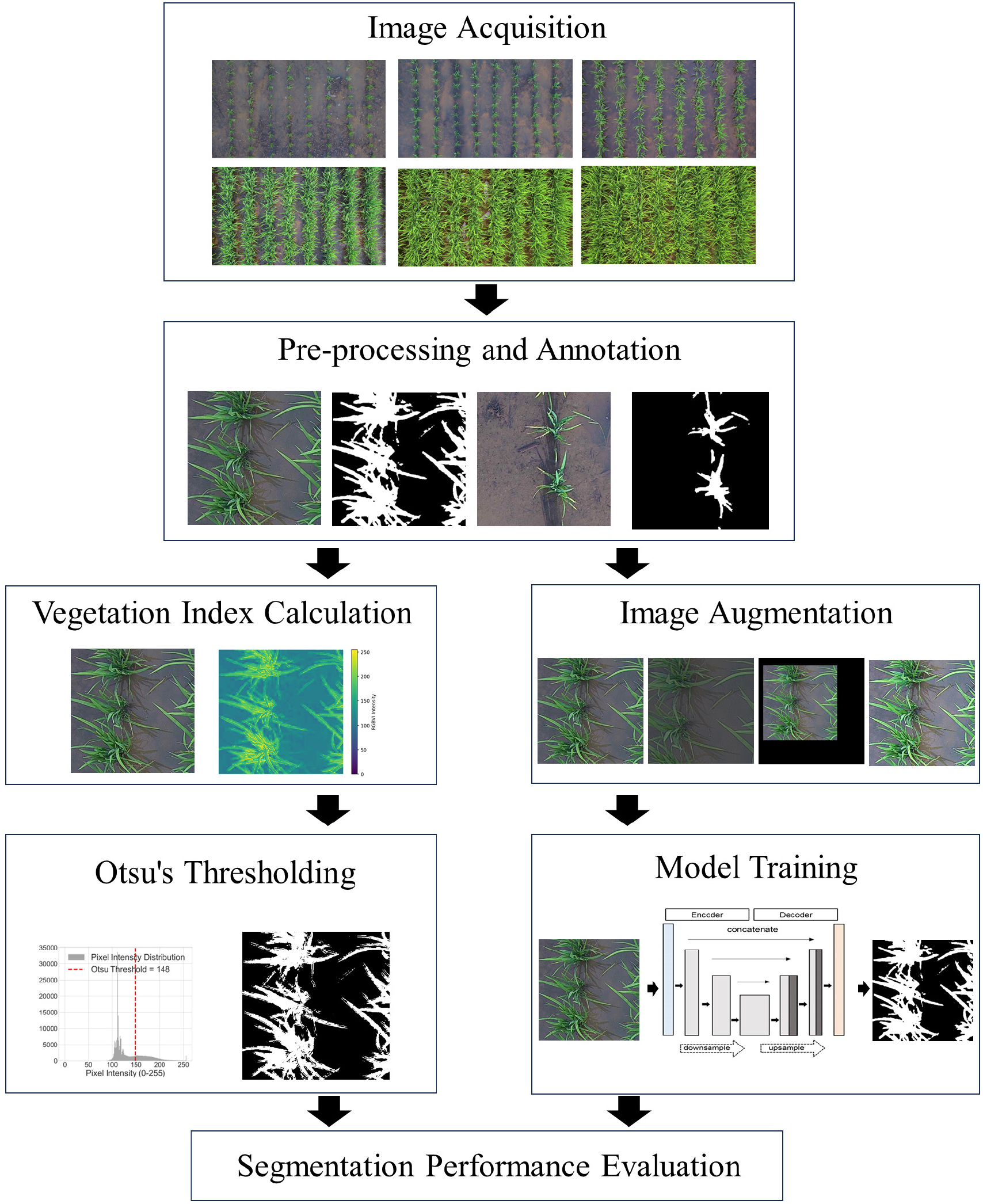

본 연구의 전체적인 흐름은 Fig. 2와 같다. 수집된 고해상도 원본 영상은 딥러닝 모델 학습에 적합한 512×512 픽셀 크기의 이미지 패치로 가공하였다. Ground Truth 데이터는 오픈소스 주석 도구인 Labelme를 사용하여 벼 영역을 픽셀 단위로 정밀하게 주석 처리한 후, 벼는 ‘1’, 배경은 ‘0’의 값을 갖는 이진 마스크(binary mask)로 변환하여 생성하였다. 최종적으로 총 5,000장의 이미지로 데이터 셋을 구축하였다.

Fig. 2.

The overall workflow of this study. This flowchart illustrates the entire process, from initial image acquisition to data pre-processing and annotation, followed by two parallel analysis pipelines: one for traditional vegetation index methods and another for deep learning model training, culminating in a comprehensive performance evaluation.

구축된 전체 데이터 셋은 모델의 학습, 검증, 최종 성능 평가를 위해 총 5,000장의 이미지를 6:2:2의 비율, 즉 학습(Training) 60%, 검증(Validation) 20%, 시험(Test) 20%으로 무작위 분할하였다. 무작위 분할에 따른 데이터 편향을 최소화하기 위해 서로 다른 난수를 지정하여 약 10회 무작위 분할을 반복 수행하였으며, 지역 및 생육 단계별 영상 분포가 균형적인 경우를 최종 학습 데이터로 선정하였다. 모델의 일반화 성능과 강건성을 높이기 위해, 학습 데이터셋에 한하여 데이터 증강을 적용하였다. 데이터 증강은 albumentations 라이브러리를 사용하였으며, 좌우 반전, 상하 반전, 임의 밝기 및 대비 조절, 그리고 이동, 크기 조절, 회전 기법을 무작위로 적용하였다. 검증 및 시험 데이터셋에는 증강을 적용하지 않고, 모든 데이터셋에 이미지 크기 조정과 ImageNet의 평균 및 표준편차를 이용한 정규화를 공통적으로 수행하였다.

분할 모델 및 학습 환경

RGB 식생지수 기반 분할

딥러닝 모델의 성능을 객관적으로 평가하기 위한 기준선으로 농업 영상 분석 분야에서 전통적으로 활용되어 온 RGB 식생지수 기반의 분할 기법을 사용하였다. 분할에 사용한 식생지수는 선행 연구에서 유의미한 성능을 보인 5개의 지표로 선정하였으며, 각 지수의 계산식은 Table 1과 같다. 각 지수는 R, G, B 채널 값과 그 값을 정규화한 r, g, b (r = R/(R+G+B), g = G/(R+G+B), b = B/(R+G+B))를 이용하여 계산되었다. 계산된 1채널 지수 이미지에 Otsu (1979)의 이진화 알고리즘을 적용하여 벼 군락과 배경을 분리하였다.

Table 1.

Formulas of the RGB vegetation indices used in this study.

| Vegetation Index | Formula | Characteristic | Reference |

| Excess Green (ExG) | 2g-r-b | Efficiently separates green vegetation from soil and residue backgrounds under variable lighting conditions | Woebbecke et al. (1995) |

| Normalized Green Red Difference Index (NGRDI) | Provides a normalized measure of vegetation greenness by contrasting red absorption and green reflectance | Tucker (1979) | |

| Modified Green Red Vegetation Index (MGRVI) | Enhances vegetation contrast and minimizes soil background interference in visible-spectrum imagery. | Bendig et al. (2015) | |

| Green Leaf Index (GLI) | Integrates all RGB channels to enhance canopy discrimination from background surfaces | Louhaichi et al. (2001) | |

|

Red Green Blue Vegetation Index (RGBVI) | Combines visible spectral ratios to correlate with crop biomass and canopy density | Bendig et al. (2015) |

CNN 기반 분할 모델

벼 군락 분할에 가장 적합한 아키텍처를 탐색하기 위해, Semantic Segmentation 분야에서 널리 사용되는 5가지 CNN 기반 모델의 성능을 비교 평가하였다. Segmentation models pytorch 라이브러리를 통해 U-net, DeepLabV3+, FPN, LinkNet, PSPNet 모델을 구현하였다. 공정한 성능 비교를 위해, 모든 모델의 특징 추출기(encoder)는 ImageNet 데이터셋으로 사전 학습된 ResNet-101을 백본 네트워크로 통일하여 아키텍처 자체의 구조적 차이에 따른 성능을 분석하고자 하였다.

본 연구에서는 Atrous Convolution을 활용하는 DeepLabV3+ (Chen et al., 2018), 특징 피라미드 구조의 FPN (Lin et al., 2017), 경량화된 구조의 LinkNet (Chaurasia & Culurciello, 2017), Pyramid Pooling Module을 사용하는 PSPNet (Zhao et al., 2017), 인코더-디코더 구조의 U-Net (Ronneberger et al., 2015)을 사용하였다.

모델 학습 및 평가 방법

모델 학습은 Pytorch 프레임워크를 기반으로 NVIDIA Quadro RTX 5000 GPU 환경에서 5가지 모델에 대해 순차적으로 진행되었다. 모든 모델은 동일한 하이퍼파라미터로 학습되었다(Table 2). 옵티마이저로는 RMSprop을 사용하였으며, 학습률은 1e-5, 가중치 감쇠는 1e-5로 설정하였다. 손실 함수는 이진 분류 문제에 효과적인 BCEWith LogitsLoss를 사용하였고, 배치 크기는 8로 설정하였다.

Table 2.

Model hyperparameter configuration.

과적합을 방지하고 최적의 모델을 선택하기 위해 조기 종료 기법을 적용하였다. 검증 손실을 모니터링하여 10 에폭(epoch)동안 성능 개선이 없을 경우 학습을 자동으로 중단하였으며, 학습 과정 중 검증 손실이 가장 낮았던 시점의 모델 가중치를 각 아키텍처의 최적 모델로 저장하였다.

최종 성능 평가는 학습에 사용되지 않은 별도의 시험(test) 데이터셋으로 수행되었다. 평가 지표로는 정확도(Pixel Accuracy), 정밀도(Precision), 재현율(Recall), F1-Score, 그리고 mIOU (mean Intersection over Union)를 사용하였다(식 (1), (2), (3), (4), (5)). 이 중 모델 간의 분할 성능 비교를 위한 핵심 지표는 mIOU로 설정하였다. 각 모델의 최종 평가 결과는 pandas 라이브러리를 통해 체계적으로 요약하여 정량적인 비교 분석이 가능하도록 하였다. 여기서 각 항목은 분할된 이미지의 픽셀 단위를 기준으로 정의된다.

본 연구의 Positive 클래스는 ‘벼’ 픽셀이며, Negative 클래스는 ‘배경’ 픽셀에 해당한다. 이에 따라 TP (True Positive)는 실제 ‘벼’를 ‘벼’로 올바르게 분류한 픽셀을 의미하며, TN (True Negative)은 실제 ‘배경’을 ‘배경’으로 정확하게 분류한 픽셀을 말한다. 반면, 분류 오류에는 두 가지 유형이 있다. FP (False Positive)는 실제로는 ‘배경’임에도 모델이 ‘벼’로 잘못 예측한 경우인 제1형 오류이며, FN (False Negative)은 실제로는 ‘벼’이지만 모델이 ‘배경’으로 잘못 분류한 제2형 오류를 지칭한다.

결과 및 고찰

딥러닝 모델 학습 과정

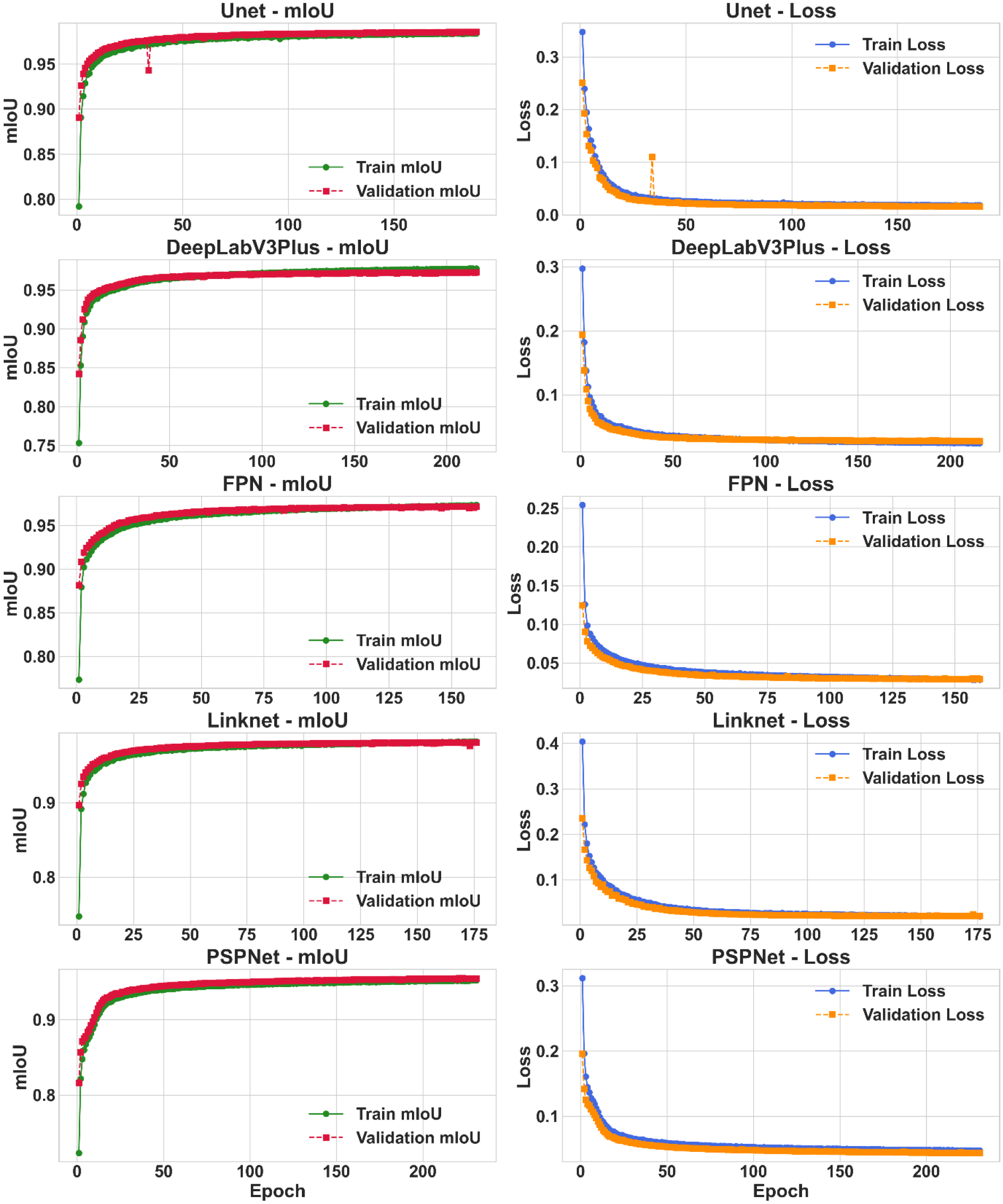

Fig. 3은 5가지 딥러닝 모델의 학습 과정에서 에폭(epoch)에 따른 mIOU와 손실(loss)의 변화를 보여준다. 모든 모델에서 학습이 진행됨에 따라 학습(Train) 및 검증(Validation) 손실은 안정적으로 감소하고 mIOU는 점차 수렴하는 이상적인 학습 양상을 보였다.

Fig. 3.

Training and validation performance curves for the five convolutional neural network (CNN)-based segmentation models over epochs. The left column shows the mean Intersection over Union (mIOU), and the right column shows the loss values. The stable convergence of both metrics for training and validation sets indicates that the models were trained effectively without significant overfitting.

모델별 수렴 속도와 안정성이 중요한 부분인데 특히 U-Net, DeepLabV3+, LinkNet 모델은 학습 초기 약 25 에폭 이내에 검증 mIOU가 0.95에 근접하는 매우 빠른 수렴 속도를 나타냈다. 이는 해당 아키텍처들이 벼 군락의 특징을 효율적으로 학습했음을 의미한다. 모든 모델의 검증 손실 곡선이 큰 변동 없이 매끄럽게 감소하는 것은 데이터 증강과 안정적인 하이퍼파라미터 설정이 효과적으로 작동했음을 보여준다.

또한, 조기 종료 기법이 각 모델의 최적점에서 학습을 중단시켰음을 확인할 수 있다. 예를 들어 PSPNet은 약 175 에폭에서 검증 손실 개선이 정체되어 학습이 종료된 반면, U-Net은 200 에폭을 넘어서까지 미세한 성능 개선을 이루었다. 이는 과적합을 방지하면서도 각 모델 아키텍처가 도달할 수 있는 최적의 성능을 효과적으로 포착했음을 의미한다.

분할 성능 정량 평가

Table 3은 독립된 시험(test) 데이터셋으로 최종 성능을 평가한 결과이다. 모든 모델을 동일 조건에서 3회 반복 학습한 결과, 성능 지표의 변동 폭이 매우 작았으며 모든 반복 실험에서 일관된 경향을 보여 모델 간 성능 차이가 우연에 의한 변동이 아님을 확인하였다. 모든 CNN 기반 딥러닝 모델이 전통적인 식생지수 기반 방법보다 탁월한 성능을 보였는데, 딥러닝 모델 중 가장 낮은 성능을 보인 PSPNet의 mIOU 값은 0.9555로 식생지수 방법 중 가장 분할 성능이 좋았던 RGBVI (0.8095)보다 확연히 높은 성능을 보였다.

식생지수 간 분할 성능을 비교한 결과, 5개의 식생지수 중 RGBVI가 mIOU 0.8095로 가장 높은 성능을 보였고 그 다음으로 MGRVI가 0.789의 높은 성능을 보였다. 이 두 지수는 다른 지수들에 비해 재현율(Recall)이 비교적 높아, 벼 군락 영역을 누락하는 정도가 적고 정밀도(Precision)와 재현율 간의 균형이 잘 맞는 것으로 나타났다. 반면 ExG, NGRDI, GLI는 재현율이 낮아 벼 군락을 과소 분할하는 경향이 있었다.

5가지 CNN 모델 중에서는 U-net 모델이 mIOU 0.9858, F1-Score 0.9929로 모든 평가지표에서 가장 우수한 성능을 보였다. 그 뒤를 이어 LinkNet (mIOU 0.9810), DeepLabV3+ (mIOU 0.9730), FPN (mIOU 0.9720) 순으로 높은 성능을 보여, 이들 아키텍처 역시 벼 군락 분할에 효과적임을 확인하였다.

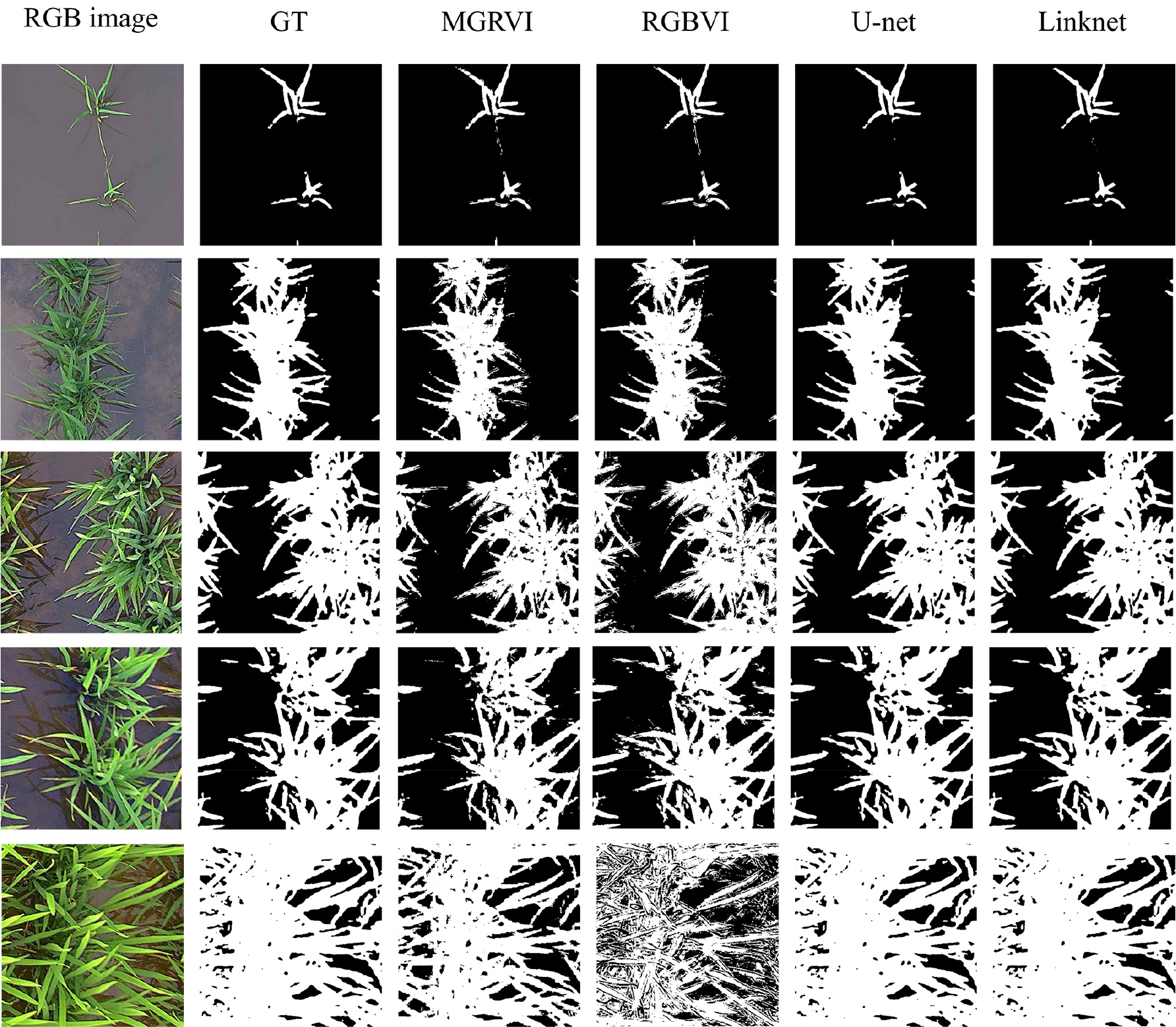

방법론별 분할 결과의 시각적 비교

Fig. 4는 생육 초기, 잎의 밀도가 높은 시기, 그리고 역광과 같은 까다로운 조건에서 각 방법론의 분할 결과를 시각적으로 비교한 결과이다. 특히 식생지수가 분할에 취약하였던 조건을 세 가지로 유형화할 수 있었다.

Fig. 4.

Qualitative comparison of segmentation results from different methods under various challenging conditions. The rows display results for images taken at the early growth stage, with complex canopy structures, and under backlighting. The columns show the original RGB image, the ground truth (GT), results from two vegetation indices (MGRVI, RGBVI), and results from two top-performing deep learning models (U-net, LinkNet). Vegetation index-based methods showed limited robustness under conditions such as soil exposure in the early stage, complex canopy overlaps, and backlighting-induced color distortion, whereas convolutional neural network (CNN)-based models produced stable and accurate segmentation across all conditions.

첫째, 광 환경 변화이다. 식생지수는 픽셀의 색상 정보(RGB)에만 의존하여 임계값을 적용하기 때문에, 역광이나 구름에 의한 그림자가 발생할 경우 잎의 색상 정보가 왜곡되어 식생을 탐지하지 못하는 오류가 빈번하였다. 특히 RGBVI는 역광 조건에서 식생 영역을 거의 탐지하지 못하는 등 광 조건에 민감한 한계를 보였다.

둘째, 배경 간섭 문제이다. 생육 초기 단계에서는 논에 물이 차 있어 수면이 노출되는데, 이때 벼 잎이 수면에 반사되어 녹색을 띠는 현상이 발생한다. 식생지수 기반 방법은 단순히 픽셀의 색상 정보에 의존하기 때문에, 이러한 수면 반사 영역을 실제 벼 군락으로 오인하여 피복도를 과대 산정하거나, 반대로 그림자가 진 영역은 누락하는 등 불안정한 양상을 보였다.

셋째, 군락 구조의 복잡성이다. 영양 생장이 왕성해짐에 따라 분얼이 증가하고 잎들이 서로 겹치며 얽히는 현상이 심화되었다. 이로 인해 군락 내부에는 상위 엽에 의해 가려진 그림자가 다수 형성되는데, 단순 색상 정보에 의존하는 식생지수 기법은 이러한 음영진 식생 영역을 벼가 아닌 배경으로 분류하는 경향을 나타내었다. 또한, 잎의 밀도가 높아질수록 개체 간의 경계가 모호해지고 색상 대비가 낮아짐에 따라, 단순 임계값 방식으로는 밀집된 벼 군락의 정교한 형태를 온전히 분리해내는 데 근본적인 한계가 있었다.

반면, 딥러닝 모델들은 데이터로부터 색상뿐만 아니라 잎의 질감, 형태, 공간적 맥락 등 복합적인 특징을 학습했기 때문에 이러한 까다로운 조건에서도 안정적인 분할 결과를 생성했다. 그 중에서도 U-net과 LinkNet은 Ground Truth (GT)와 가장 유사하게 벼의 복잡한 형태를 정교하게 복원했다. 특히 U-net은 가장 가느다란 잎 끝부분과 겹친 영역의 경계면까지 명확하게 분할해내며 가장 뛰어난 성능을 보였다. 이는 U-net이 인코더와 디코더를 직접 연결하는 skip connection 구조를 가져 벼 잎의 미세한 경계 정보를 정교하게 복원할 수 있기 때문으로 판단된다. 이러한 시각적 분석 결과는 딥러닝 모델, 특히 U-net이 식생지수 방법에 비해 확연히 높은 정확도와 강건성을 가짐을 시각적으로 증명하며, 이는 Table 3의 정량적 평가 결과를 뒷받침한다.

Table 3.

Quantitative performance comparison between vegetation index methods and deep learning models on the independent test set.

시계열 피복도 변화 분석

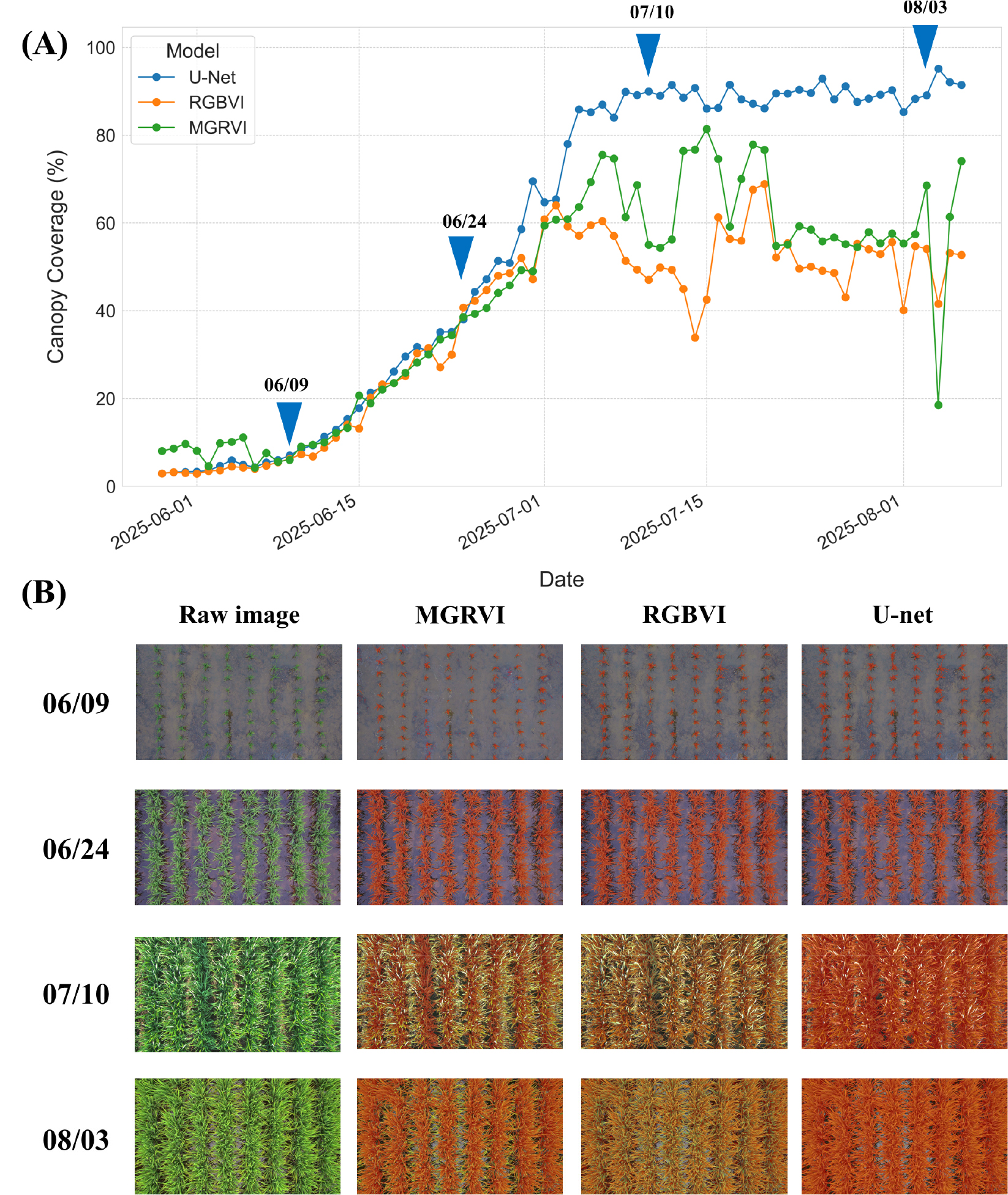

개발된 모델의 안정성과 실제 활용 가능성을 평가하기 위해, 생육 기간 전체에 걸친 피복도 변화를 시계열로 추적하고 분석하였다(Fig. 5).

Fig. 5.

Time-series analysis of canopy coverage estimation using selected methods. (A) A line graph tracking the canopy coverage percentage over the growing season, comparing the stability of deep learning model (U-net) against vegetation index-based methods (RGBVI, MGRVI). (B) Visualized segmentation masks at key growth stages, illustrating the consistency of U-net compared to the variability of vegetation index methods, using full-frame original images (3,840 × 2,160 resolution). Vegetation index-based methods exhibited large temporal fluctuations due to lighting changes, shadow effects, and reflectance saturation, while deep learning models maintained smooth and stable canopy coverage trends consistent with actual growth stages.

특히 U-net은 생육 초기부터 후기까지 실제 벼의 생장 패턴과 부합하는 안정적인 시계열 추이를 보였다(Fig. 5A). 시계열 안정성을 정량적으로 평가하기 위해 일간 피복도 변화량의 표준편차(SD)를 분석한 결과, 생육이 왕성한 초기(7월 3일 이전)에는 모든 방법론이 유사한 수준의 변동성(SD ≈ 3.0~3.5)을 보였다. 그러나 군락 피복이 포화되어 구조가 복잡해지는 생육 후기(7월 3일 이후)에 이르자, U-net의 변동성은 오히려 감소하여 안정화된 반면, 식생지수 기반인 RGBVI (SD=8.02)와 MGRVI (SD=14.30)는 변동폭이 급격히 증가하는 경향을 나타냈다. 결과적으로 포화 후 시기에서 U-net은 RGBVI 대비 약 2.7배, MGRVI 대비 약 4.8배 더 높은 시계열 안정성을 입증하였으며, 이는 딥러닝 모델이 밀식 환경의 미세한 광 환경 변화나 그림자 영향에 강건함을 시사한다.

반면, 식생지수 기반의 방법들은 곡선의 변동성이 매우 크고, 특정 시점에서 피복도를 비정상적으로 과소평가하는 등 불안정한 추정 결과를 보였다. 이러한 불안정성은 Fig. 5B의 분할 마스크에서도 명확히 확인되었다. 예시로 벼의 생육이 왕성한 7월 10일 시점에서 식생지수 모델들은 피복도 값이 급격히 하락했는데, 이는 짙어진 잎의 색이나 군락 내부의 미세한 그림자로 인해 벼 영역을 배경으로 오분류했기 때문이다. 이와 달리 U-net은 동일한 조건에서도 벼 군락을 정확하게 분할하여 안정적인 피복도 값을 유지했다.

결론적으로, 식생지수 방법의 높은 변동성은 실제 생육 변화가 아닌 외부 환경 요인에 대한 민감도를 반영하는 노이즈에 가깝다. 이와 대조적으로, 딥러닝 기반의 모델인 U-net 모델은 시계열 분석 전반에 걸쳐 높은 정확도와 강건성을 입증함으로써, 신뢰도 높은 생육 데이터를 자동으로 확보하는 정밀 농업 기술로서의 활용 가치가 높을 것으로 사료된다.

다만, 본 연구의 평가 방식에 있어 한 가지 고려할 점은 데이터 분할 전략이다. 본 연구는 대한민국 전역의 다양한 환경 변이를 모델이 충분히 학습할 수 있도록 전국 18개 지역의 데이터를 무작위로 혼합하여 학습 및 평가 데이터셋을 구성하였다. 이는 전국 단위의 범용적 모델을 구축하기 위한 목적이었으나, 결과적으로 평가 데이터가 학습 데이터와 유사한 분포를 공유하는 분포 내(In-domain) 평가의 성격을 갖는다. 따라서 학습 과정에서 전혀 경험하지 못한 새로운 지역이나 품종 환경에 모델을 적용할 경우, 데이터 분포 차이(Domain Shift)에 따른 성능 변화가 발생할 가능성이 존재한다. 향후 연구에서는 지역 단위의 교차 검증(Leave- one-region-out)이나 도메인 적응(Domain Adaptation) 기법을 도입하여, 미지의 환경에 대한 모델의 일반화 성능을 더욱 엄격하게 검증하고 고도화할 필요가 있다.

적 요

벼의 군락 피복도는 광합성량과 바이오매스 축적을 반영하여 생육을 진단하고 수량을 예측하는 핵심 농업 형질이지만, 기존의 직접 측정 방식은 많은 시간과 노력이 요구되는 한계가 있다. 본 연구는 이를 극복하고자, RGB 영상으로부터 피복도를 자동으로 정밀하게 추정하기 위한 최적의 방법론을 탐색하였다. 이를 위해 전통적인 5종의 식생지수 방법과 U-Net, DeepLabV3+ 등이 포함된 5종의 주요 CNN 기반 분할 모델의 성능을 정량적으로 비교 분석하였다. 대한민국 내 평야지, 중산간지 등 다양한 농업 기후대를 대표하는 18개 지역에서 시계열로 수집한 5,000장의 고해상도 이미지로 데이터셋을 구축하였으며, mIOU를 핵심 지표로 각 모델의 분할 정확도를 평가하였다. 평가 결과에서 딥러닝 기반의 분할 성능은 식생지수에 비해서 높은 성능을 나타내었으며 CNN 모델 중에서는 U-Net 아키텍처가 mIOU 0.986으로 가장 뛰어난 성능을 보였다. 딥러닝 기반의 분할 모델은 전체 생육 기간에 걸친 시계열 분석에서 일별 환경 변화에 강건한 안정성을 보이며, 실제 벼의 생장 곡선을 가장 안정적으로 추적하여 높은 실용성을 입증하였다. 이는 향후 필지별 맞춤형 관리를 통한 정밀 농업을 구현하고, 디지털 기반의 작황 예측 기술을 고도화하는 핵심 기반기술로 활용될 수 있다는 점에서 큰 의의를 갖는다. 본 연구는 RGB 영상 기반의 벼 피복도 분석을 중심으로 수행하였으며, 향후 UAV 영상이나 타 작물 분석에 적용함으로써 다양한 작물의 생육 진단과 모니터링에 활용될 것으로 기대된다.