서 론

재료 및 방법

실험 재배지 및 현장 조사

UAV 촬영 및 영상 전처리

학습 데이터 구축 및 분류 모델 구성

정확도 검증 및 평가지표

결과 및 고찰

영상-기계학습 조합별 정량적 성능 비교

클래스별 면적 변화 및 변수 중요도 분석

Ground truth 기반 모델 검증

적 요

서 론

농작물의 지상부가 수직 상태에서 벗어나 지표면 쪽으로 기울어지거나 쓰러지는 현상인 도복(Lodging)은 농작물 생산지에 빈번히 발생하며, 수확량과 품질 저하 등 다양한 농업적 손실을 유발한다(Amaya et al., 1996; Murakamiet al., 2012; Lee et al., 2023).

도복의 원인은 급작스러운 강우, 강풍과 같은 직접적인 물리적 요인과 비료 과시용, 부적절한 배수 등 간접적인 생육 환경 요인으로 나눌 수 있다(Lim et al., 1992). 도복은 형태에 따라, 작물의 지상부 혹은 줄기가 부러지거나 구부러지는 줄기 도복(Stem Lodging)과 뿌리의 생육 저하 등으로 식물체가 쓰러지는 뿌리 도복(Root Lodging)으로 구분되며, 줄기 도복은 생산성 저하에 더 큰 영향을 미치는 것으로 알려져 있다(Zuo et al., 2017; Mulsanti et al., 2018; Wang et al., 2022; Li et al., 2022).

일반적으로 밀 생육기간 중 절간신장기와 개화기에 도복이 발생하여 수량 감소, 품질 저하, 수확 효율 감소 등의 문제를 초래한다. 그러나 최근 이상기후로 인해 등숙기와 같은 밀의 생육 후기에도 도복 발생이 빈번해지고 있으며, 생육 후기의 도복은 20~61%까지 수확량을 감소시키는 것으로 보고되었다(Berry et al., 2003; Foulkes et al., 2011; Berry & Spink, 2012; Mardanisamani et al., 2019).

이처럼 생산성과 품질 측면에서 심각한 손실을 유발하는 밀 재배지에서의 도복은 발생 규모와 피해 정도를 신속하고 정확하게 파악하는 것이 중요하다. 지금까지 밀 재배지에서의 전통적인 도복 조사는 넓은 면적에 대한 현장 조사가 일반적으로 수행되어 왔으나, 시간과 노동력의 제약으로 인해 대안이 필요한 시점이다(Bock et al., 2010; Chu et al., 2017; Han et al., 2018; Li et al., 2021).

위성을 활용한 거시적 관측을 통해 농작물의 생육 및 재배 환경을 평가하던 초기의 농업 원격탐사는 작물 재배지에서 발생하는 도복에 대해서도 평가를 수행하여왔다. RADASTA-2, Sentinel-1 등의 위성영상자료는 밀, 옥수수, 사탕수수 등 대규모 작물 재배지에서 발생하는 도복의 발생 유무에 대해서 분석을 수행하는데 활용되었다(Yang et al., 2015; Chen et al 2016; Zhao et al., 2017; Han et al., 2017; Shu et al., 2020). 그러나 위성의 긴 재방문 주기와 구름 등에 의한 농경지의 정보를 획득할 수 없는 제한점은 시기적절한 데이터의 획득이 필요한 도복판별에서 큰 장벽으로 작용하였다(Chauhan et al., 2019a).

저고도 비행을 통한 정밀 관측과 활용 접근성이 좋은 무인항공기(UAV, Unmanned Aerial Vehicle, such as drone)는 농업 원격탐사를 활용한 정밀농업에서 그 중요도가 높아지고 있다(Weiss et al., 2020; Reza Ghafarian Malamiri et al., 2021; Rodríguez et al., 2021). RGB 센서(RGB Camera)와 다중분광 센서(Multispectral Camera) 등의 유연한 활용이 가능한 UAV는 고해상도 영상자료를 활용하여 주요 작물의 엽면적과 수확량 등 다양한 생육 지표 평가에 활용되고 있다(Zhang et al., 2022; Jung et al., 2023).

기술의 발전과 함께 인공지능(AI, Artificial Intelligence)의 활용이 다양한 분야에서 확대되고 있으며, 농업 분야에서도 이를 활용한 응용 연구가 활발히 진행되고 있다. 특히 공간 정보 데이터와 결합한 기계학습(ML, Machine Learning) 알고리즘은 대규모 관측 데이터를 분석하고, 작물 생육이나 환경 변화와 같은 의미 있는 정보를 효과적으로 추출할 수 있다(Zhao et al., 2020; Zhang et al., 2020).

중국과 인도 등 밀의 주요 생산국에서는 UAV를 활용한 원격탐사자료와 AI기반 기계학습을 결합하여 밀의 생산성 예측, 도복 피해 탐지 등 재배 환경에 대한 정밀 분석을 수행하고 이에 기반하여 의사결정 지원을 위한 다양한 데이터를 구축하고 있다(Yu et al., 2022; Zang et al., 2024; Sharda et al., 2025).

품질 개선과 재배면적 확대 등 밀 자급률 향상이 주요 목표인 국내에서는 UAV를 활용한 수확량과 품질평가에 관한 연구가 주를 이루고 있으나, 상대적으로 도복과 같은 재배 환경에 관한 연구는 미비한 실정이다(Lee et al., 2020; Jung et al., 2024).

이에 본 연구는 밀 재배지에서 발생한 도복 피해를 정밀하게 분석하고자, UAV로 촬영한 RGB 및 다중분광 영상자료를 활용하여 Random Forest (RF), Extreme Gradient Boosting (XGB)과 K-Nearest Neighbors (KNN) 알고리즘 기반의 도복 분류를 수행하고, 영상 유형 및 기계학습 알고리즘에 따른 도복 탐지 성능을 비교·평가함으로써 국내 밀 재배지에서 UAV 기반 영상정보의 도복 탐지 활용 가능성을 검토하고자 하였다.

재료 및 방법

실험 재배지 및 현장 조사

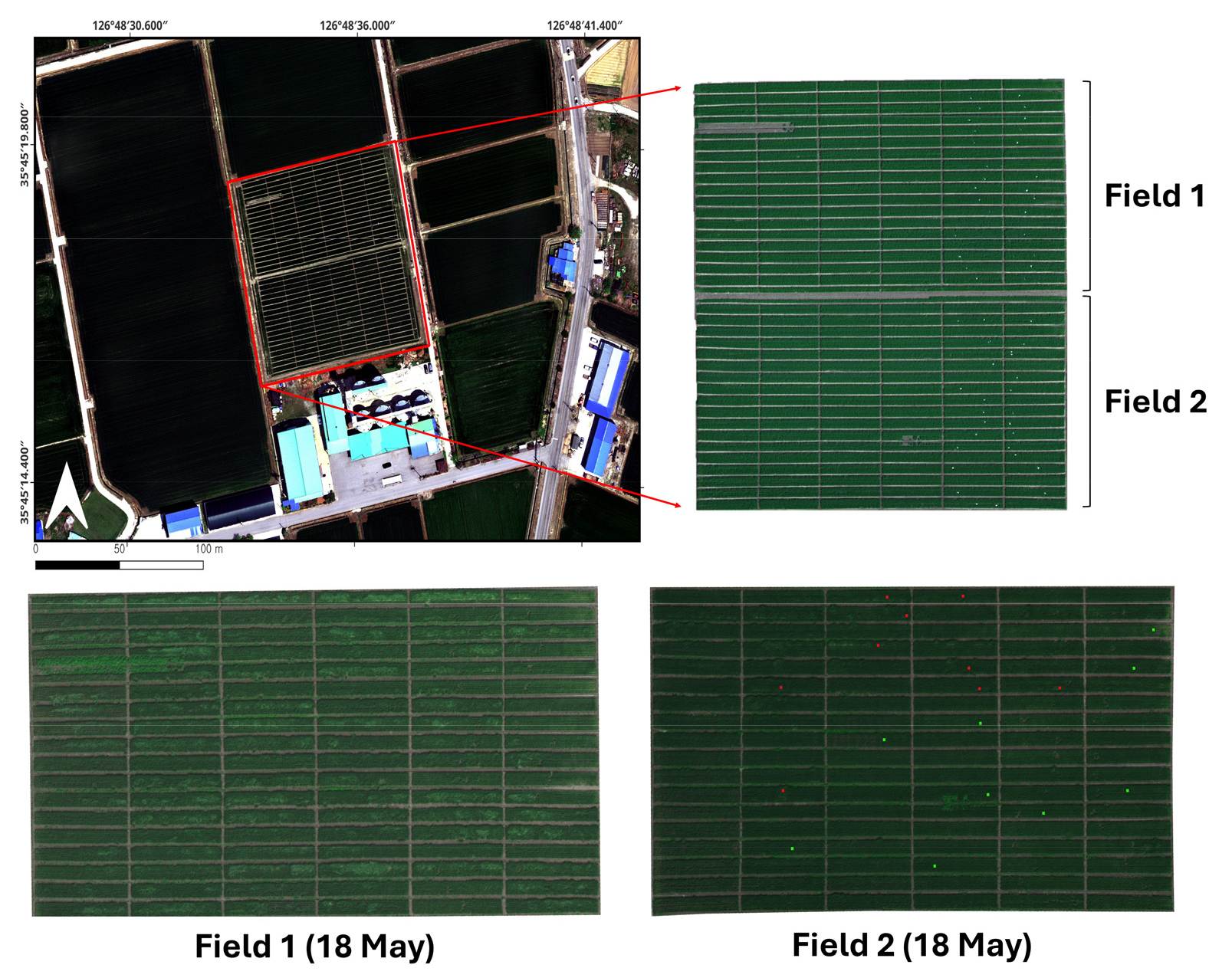

본 연구는 전라북도 김제시 죽산면 연포리에 위치한 면적 9,400m²의 밀 재배지(35°45'18.2"N, 126°48'35.7"E)를 대상으로 수행하였다(Fig. 1). 해당 시험지에는 국내 제빵용 경질밀 품종인 백강(BG)과 황금알(HG)이 각각 Field 1과 Field 2에 재배되고 있었으며, 각 필드에는 28 m² 크기의 재배 배드가 108개씩 조성되어 밀 재배가 이루어지고 있었다. UAV 영상을 활용한 도복판별 영상 결과와의 비교분석을 위해 Field 2에서 0.25 m²의 면적에 대해 도복 밀, 비 도복 밀 구역을 9곳씩 선정하여 현장 조사(Ground truth) 자료로 기록하였다.

UAV 촬영 및 영상 전처리

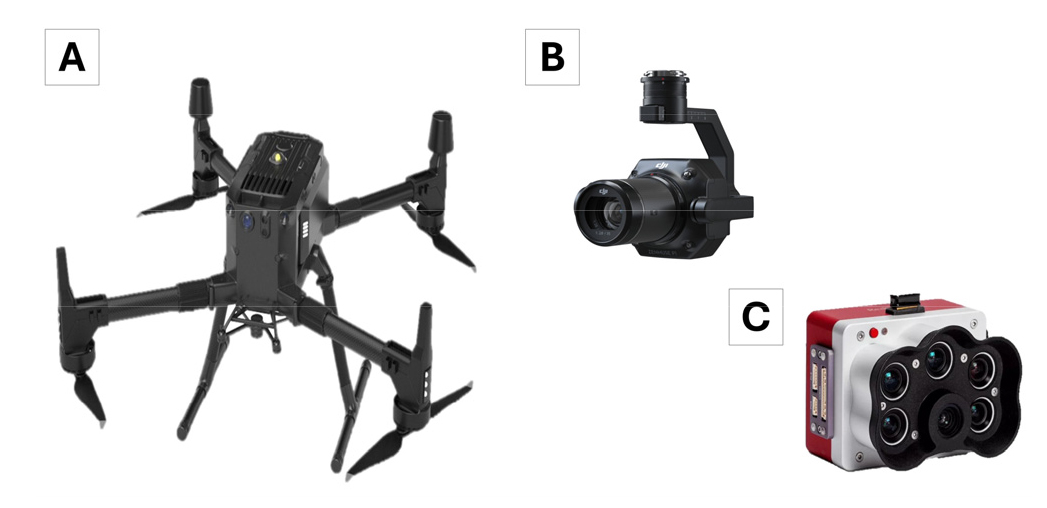

UAV 영상 촬영은 쿼드콥터 회전익 드론 ‘Matice 300’ (M300, DJI, China)에 RGB 카메라 ‘Zenmuse P1’ (DJI, China)와 가시광선(Red, Green, Blue), 적색 경계(Red-Edge), 근적외선(NIR, Near Infrared)파장 촬영이 가능한 ‘REDEDGE-P1’(Micasence, UAS)를 장착하여 2025년 5월 18일 촬영을 진행하였다(Fig. 2, Table 1). ‘Zenmuse P1’과 ‘REDEDGE-P1’의 촬영고도는 각각 40 m와 50 m로 상이하였으나, 횡 중복도, 종 중복도, 비행 속도등 기타 환경은 동일하게 진행하였다(Table 2). 각각의 센서로 촬영된 낱장의 사진은 분석을 위해 전처리 프로그램 Pix4D mapper (Pix4D, Lausanne, Switzerland)를 이용하여 하나의 정사영상으로 합성을 수행하였다.

Fig. 2.

UAV and sensor systems used in this study. (A) DJI Matrice 300 RTK, a commercial multirotor drone platform; (B) Zenmuse P1 (DJI, China), a full-frame RGB camera for high-resolution aerial mapping; (C) REDEDGE-P (Micasense, USA), a multispectral sensor capable capturing narrowband reflectance data in five spectral bands.

Table 1

UAV and sensor specifications.

Table 2

UAV utilization configuration for data collection.

학습 데이터 구축 및 분류 모델 구성

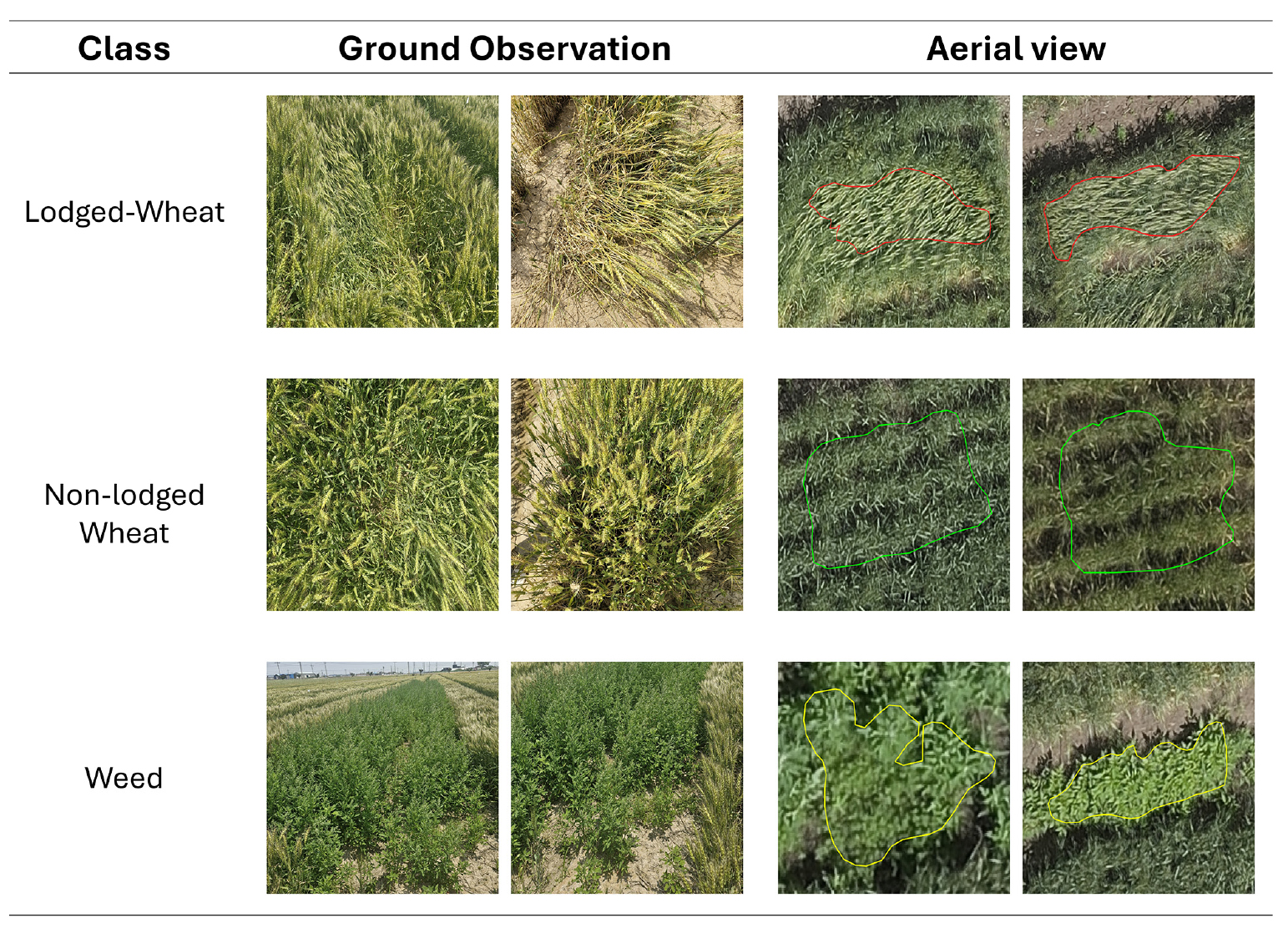

UAV를 활용한 밀 재배지에서의 도복 판독을 수행한 선행연구의 경우, 단순 도복과 비 도복 2가지의 클래스만 설정하여 분류를 수행했으며, 이러한 단순화된 방법은 식생 배경의 다양성을 반영하지 못하는 한계가 존재한다고 지적되었다 (Chauhan et al., 2019a). 이를 보완하기 위해 총 5개의 클래스 (Class 0:도복 밀, Class 1:비도복 밀, Class 2:잡초, Class 3:토양, Class 4:그림자)를 설정하고, GIS 프로그램 QGIS (Quantum GIS) version 3.42.1을 활용하여 Field 1에서 각 클래스별로 40개 구역을 수동 마스킹하여 픽셀 단위 훈련 데이터셋을 구성하였다(Fig. 3).

RGB영상을 활용한 학습 및 분류시에는 R (Red Spectral Band), G (Green Spectral Band), B (Blue Spectral Band) 각각 단일밴드의 반사도와 함께 RGB색상기반 파생변수인 H (Hue), S (Saturation), V (Value)와 RGB기반 식생지수 ExG (Excess Green), ExR (Excess Red), NDI (Normalized Difference Index) 총 9종류의 feature를 사용하였다.

다중분광영상의 경우 R (Red Spectral Band), G (Green Spectral Band), B (Blue Spectral Band), RE (Red-Edge Spectral Band), NIR (Near-Infrared Spectral Band) 각각 단일밴드의 반사도와 더불어 식생의 활력, 엽록소 함량 등을 반영할 수 있는 다중분광 영상 기반 식생지수 NDVI (Normalized Difference Vegetation Index), NDRE (Normalized Difference Red-Edge Index), GNDVI (Green Normalized Difference Vegetation Index), OSAVI (Optimized Soil Adjusted Vegetation Index) 4가지를 선정하여 총 9종류의 feature를 활용하였다(Table 3).

Table 3

RGB and multispectral features and equations used for lodging detection in wheat field.

| Feature | Equation* | Reference |

| RGB | ||

|

H (Hue) | with | (Chaudhary et al., 2012) |

|

S (Saturation) | 1-[(3*min(R,G,B)) /(R+G+B)] | (Chaudhary et al., 2012) |

|

V (Value) | (R+G+B)/3 | (Chaudhary et al., 2012) |

|

ExG (Excess Green) | 2*G-R-B | (Zhang et al., 2021) |

|

ExR (Excess Red) | 1.4*R-G | (Guijarro et al., 2011) |

|

NDI (Normalized Difference Index) | (G-R)/(G+R) | (Pérez et al., 2000) |

| Multispectral | ||

|

NDVI (Normalized Difference Vegetation Index) | (NIR-RED)/(NIR+RED) | (Jordan, 1969) |

|

NDRE (Normalized Difference Red-Edge Index) | (NIR-RE)/(NIR+RE) | (Walsh et al., 2018) |

|

GNDVI (Green Normalized Difference Vegetation Index) | (NIR-G)/(NIR+G) | (Tucker, 1979) |

|

OSAVI (Optimized Soil Adjusted Vegetation Index) | (NIR-R)/(NIR+R+0.16) | (Rondeaux et al., 1996) |

기계학습은 Random Forest (RF), XGBoost (XGB), K-Nearest Neighbors (KNN) 세 가지를 적용하였다. 이들은 각기 다른 방식의 학습 구조를 기반으로 하며, 본 연구에서는 이들의 특성과 장점을 고려하여 도복 탐지에 적합한 모델로 선정하였다.

Random Forest (RF)는 훈련 데이터를 무작위로 여러 하위 집합으로 나누어 다수의 결정 트리를 생성하고, 각 트리의 예측 결과를 다수결 방식으로 종합하여 최종 분류를 수행한다. 이 과정은 과적합을 줄이고 모델의 일반화 성능을 향상시키는 데 효과적이다(Jin et al., 2020).

XGBoost (Extreme Gradient Boosting, XGB)는 이전 단계에서 발생한 오차를 다음 단계에서 보완하고, 정규화를 통해 과적합을 방지하여 모델의 일반화 성능을 향상시킨다. 연산 효율성과 높은 예측 정확도로 인해 영상 기반 분류 문제에 널리 활용되고 있다(Chen & Guestrin, 2016).

K-Nearest Neighbors(KNN)은 인접한 데이터 간의 거리를 기준으로 분류를 수행하는 비모수 학습 알고리즘으로, 예측 시 대상 데이터와 가장 가까운 k개의 이웃을 탐색하여 다수의 클래스를 기준으로 분류한다. 구조가 단순하고 해석이 용이하다는 장점이 있다(Cover & Hart, 1967).

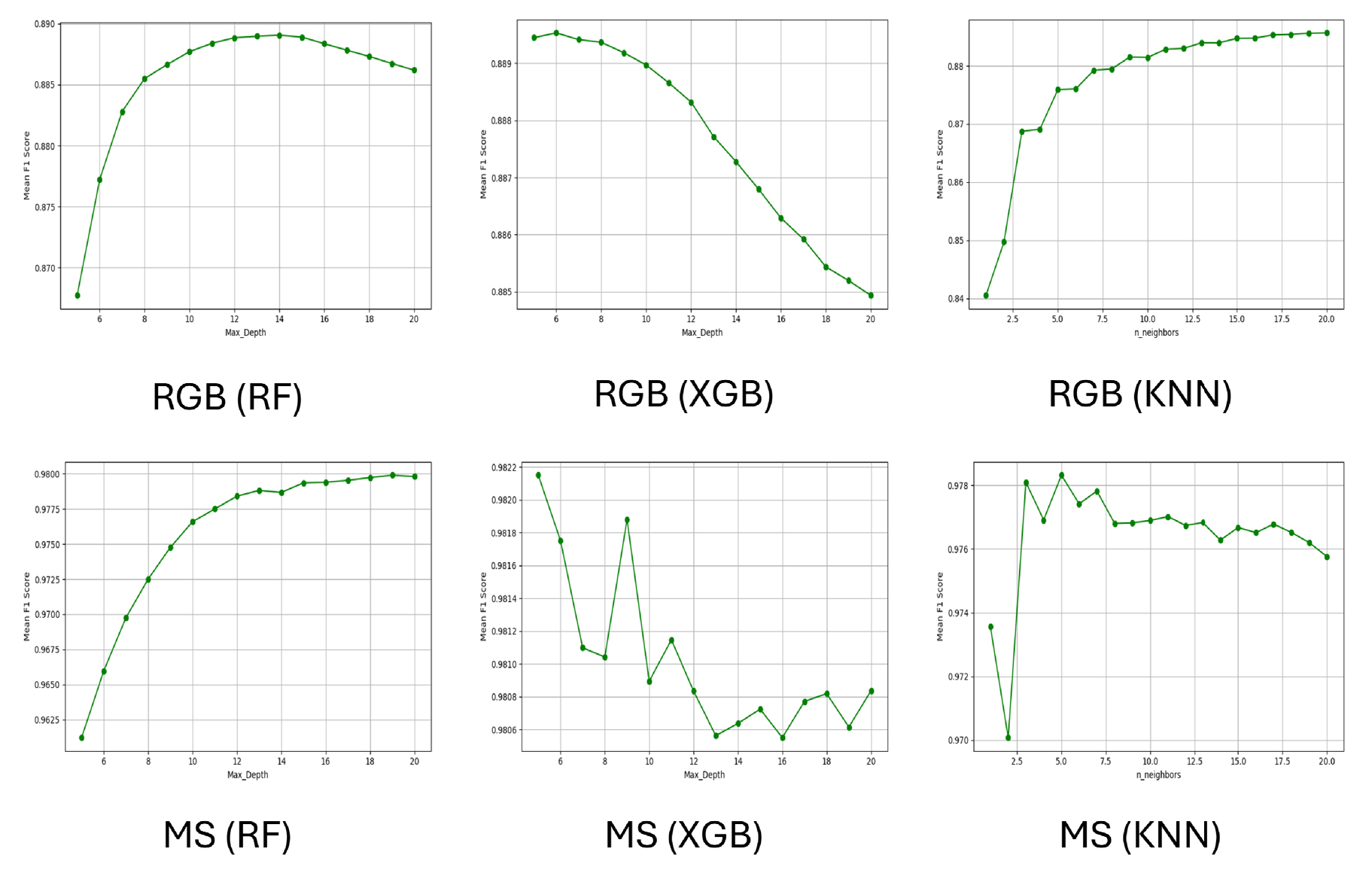

본 연구에서는 과적합을 방지하고자 RF와 XGB의 경우 결정트리 수(n_estimators)를 100으로 고정한 상태에서 교차검증을 통해 최적의 최대 트리 깊이(max depth)를 적용하여 분석하였다. 분석결과, RGB영상을 활용한 RF와 XGB의 max depth가 각각 12과 6으로 설정되었으며, 다중분광의 경우 13과 5로 설정하였다. KNN은 최근접 이웃 개수(n_neighbors, k)에 대해 성능 곡선을 분석하여 RGB와 다중분광 영상 모두 k=5를 최적값으로 결정하였다(Fig. 4).

전체 데이터는 Field 1을 학습용과 검증용으로 분할하여 모델을 학습하였으며, RF와 XGB에서는 각 입력 변수의 예측 기여도를 파악하기 위해 Feature importance 분석을 수행하였다.

Field 1은 전체 모델 학습 및 검증에 사용 되었으며, 영상 및 기계학습 조합에 따른 도복 탐지 성능을 평가하는데 활용되었다. Field 2는 학습 과정에 포함되지 않은 독립적인 검정 세트로 활용되었으며, 이를 통해 Field 1에서 학습된 최적의모델을 적용하여 예측된 도복 결과와 실제 도복 발생 지점(Ground truth)간의 공간적 일치 여부를 평가하였다.

정확도 검증 및 평가지표

기계학습 기반 분류 모델의 성능 평가는 Field 1의 데이터를 학습용(Train set)과 검증용(Validation set)으로 8:2 비율로 분할하여 예측 결과 중 실제 정답인 비율을 나타내는 정밀도(Precision), 실제 정답 중에서 모델이 정확한 예측 비율인 재현율(Recall), 정밀도와 재현율의 조화평균인 F1-Score를 산출하였다(Table 4).

다중 클래스간 지표를 각각 산출한 후 이를 비교하였으며, 전체 정확도(Overall Accuracy)는 모든 샘플중 정확히 분류된 비율로 계산하였다.

또한, 다중 클래스간 오분류 경향을 분석하기 위해 Field 1의 Validation set을 대상으로 confusion matrix를 시각화하여 각 클래스 간 혼동 패턴과 분류 특성을 평가하였다.

Table 4

Definitions and equations of evaluation metrics used for classification performance assessment.

| Metrics | Equation* |

| Precision | |

| Recall | |

| F1-Score | |

| Overall Accuracy |

*TP (True Positive), FP (False Positive), FN (False Negative), and TN (True Negative) represent the number of correctly classified samples, incorrectly predicted as the target class, target-class samples that were not correctly identified, and samples correctly excluded from the target class, respectively.

결과 및 고찰

영상-기계학습 조합별 정량적 성능 비교

Field 1을 기반으로 RGB 및 다중분광(Multispectral, MS)과 RF, XGB, KNN 기계학습을 조합하여 도복 탐지 모델의 정량적 성능을 평가하였다(Table 5). 도복 여부 판단에 가장 중요한 Class 0(도복 밀)과 Class 1(비도복 밀)의 F1-score를 비교한 결과, 모든 기계학습 모델에서 다중분광 영상 기반 모델이 RGB 영상 기반 모델보다 높은 성능을 나타내었다.

Class 0에서 RGB 영상 기반 XGB의 validation f1-score는 0.80, 다중분광 영상 기반 XGB는 0.97로 0.17 향상되었고, Class 1에서도 RGB 0.82에서 다중분광 영상은 0.97로 0.15 개선되었다. RF와 KNN 역시 RGB 대비 다중분광 영상 기반에서 성능 향상을 보였는데, Class 0은 각각 약 0.17과 0.20, Class 1은 각각 0.14와 0.17 상승하였다.

이러한 성능 향상은 다중분광 영상의 NIR과 Red-Edge 밴드가 RGB 영상에서는 식별하기 어려운 도복 밀의 생리적, 광학적 변화를 민감하게 반영한 결과로 판단되며, 이는 벼와 같은 주요 작물 재배지에서 NIR과 Red-Edge 밴드의 중요도를 언급한 선행연구와 일치한 결과를 나타내었다(Moon et al., 2021).

도복을 판단하기 위한 기계학습별 성능을 비교한 결과, RGB영상과 다중분광 영상 모두에서 XGB 모델이 가장 우수한 성능을 보였으며 RF가 그 뒤를 이었고 KNN이 가장 낮은 성능을 기록하였다. 이는 Gradient Boosting 구조를 기반으로 하는 XGB가 복잡한 다중 클래스 경계와 비선형적 분포를 안정적으로 학습하여 RGB영상과 다중분광 영상 모두에서 일관된 우수성을 보인것으로 해석된다.

Table 5

Quantitative performance metrics of RF, XGB, and KNN for lodging detection using RGB and Multispectral imagery in field 1, with values indicated as Train (Validation) for each metric.

| Class | RGB_RF | RGB_XGB | RGB_KNN | ||||||

| P* | R | F1 | P | R | F1 | P | R | F1 | |

| 0 |

0.80 (0.80) |

0.80 (0.80) |

0.80 (0.80) |

0.80 (0.79) |

0.80 (0.80) |

0.80 (0.80) |

0.77 (0.76) |

0.79 (0.79) |

0.78 (0.77) |

| 1 |

0.80 (0.80) |

0.84 (0.84) |

0.82 (0.82) |

0.80 (0.80) |

0.84 (0.84) |

0.82 (0.82) |

0.79 (0.78) |

0.81 (0.81) |

0.80 (0.79) |

| 2 |

0.96 (0.96) |

0.86 (0.86) |

0.91 (0.91) |

0.97 (0.97) |

0.86 (0.86) |

0.91 (0.91) |

0.97 (0.96) |

0.86 (0.86) |

0.91 (0.90) |

| 3 |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

| 4 |

0.95 (0.95) |

0.90 (0.89) |

0.93 (0.92) |

0.96 (0.96) |

0.89 (0.90) |

0.93 (0.92) |

0.95 (0.94) |

0.91 (0.90) |

0.93 (0.92) |

| Accuracy |

0.84 (0.84) |

0.85 (0.84) |

0.83 (0.82) | ||||||

| Class | MS_RF | MS_XGB | MS_KNN | ||||||

| P | R | F1 | P | R | F1 | P | R | F1 | |

| 0 |

0.99 (0.98) |

0.96 (0.96) |

0.97 (0.97) |

0.99 (0.98) |

0.96 (0.96) |

0.97 (0.97) |

0.98 (0.98) |

0.96 (0.95) |

0.97 (0.97) |

| 1 |

0.95 (0.95) |

0.99 (0.98) |

0.97 (0.96) |

0.96 (0.96) |

0.99 (0.98) |

0.97 (0.97) |

0.96 (0.95) |

0.98 (0.98) |

0.97 (0.96) |

| 2 |

1.00 (0.99) |

0.98 (0.98) |

0.99 (0.98) |

1.00 (0.99) |

0.99 (0.99) |

1.00 (0.99) |

1.00 (0.99) |

0.99 (0.98) |

0.99 (0.99) |

| 3 |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

1.00 (1.00) |

| 4 |

1.00 (0.98) |

0.97 (0.96) |

0.98 (0.97) |

1.00 (0.98) |

1.00 (0.98) |

1.00 (0.98) |

0.98 (0.97) |

0.98 (0.97) |

0.98 (0.97) |

| Accuracy |

0.98 (0.97) |

0.98 (0.98) |

0.98 (0.97) | ||||||

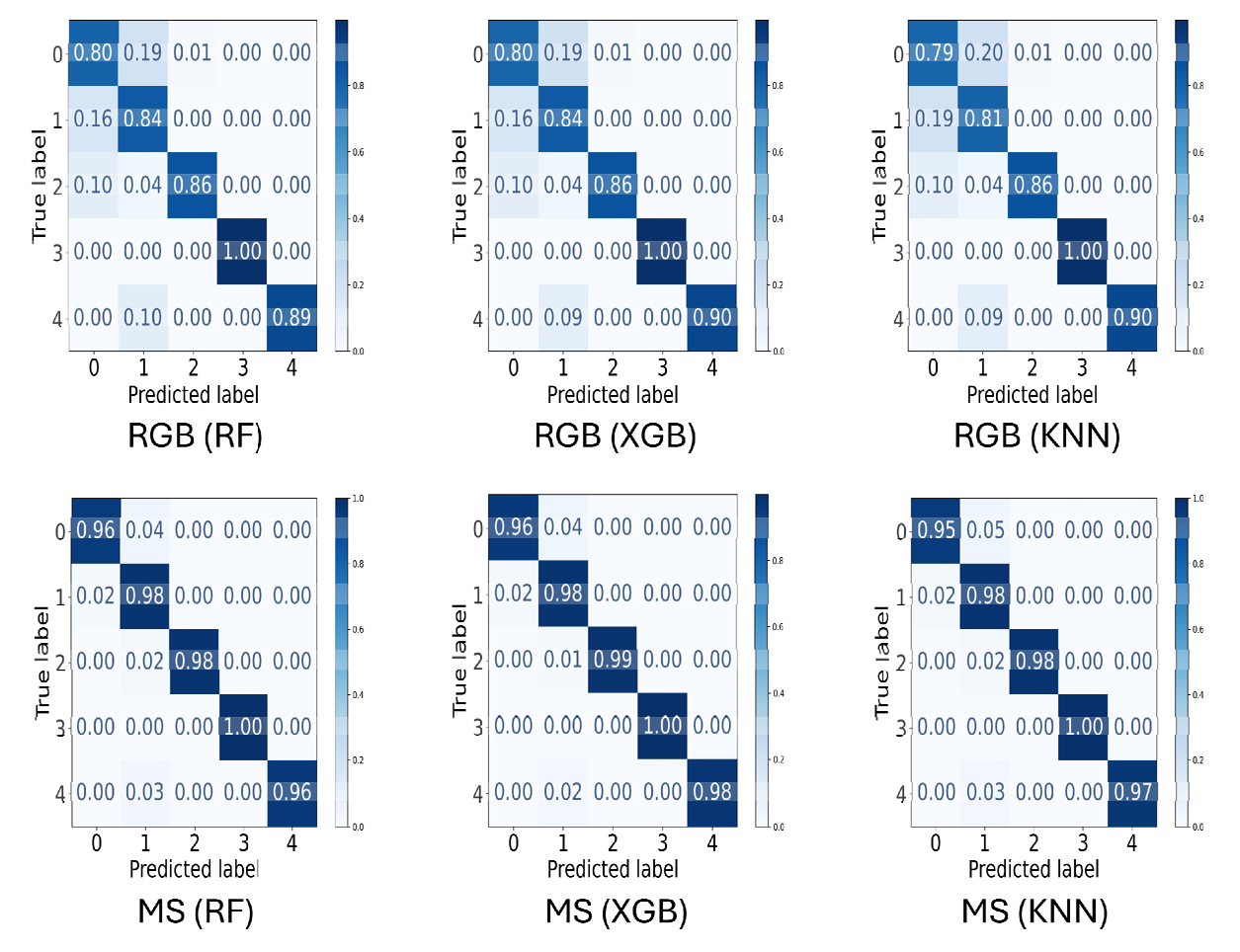

이러한 정량적 지표 결과를 보완 및 검증하기 위해 Field 1의 Validation set의 재현율(Recall) 결과를 기준으로 confusion matrix를 시각화하여 각 영상과 기계학습 조합에 따른 클래스별 예측 성능과 타 클래스와의 혼동 양상을 평가하였다 (Fig. 5).

RGB 기반 모델에서는 Class 0의 Recall이 RF와 XGB에서 0.80, KNN에서 0.79로 나타났으며, KNN에서 가장 낮은 성능을 보였다. 이는 RGB 영상에서 도복 밀과 비도복 밀의 경계가 미묘할 경우 도복 밀을 비도복 밀로 오분류하는 경향이 있음을 시사한다.

반면, 다중분광 영상 기반 모델에서는 Class 0에 대해 0.95~0.96의 Recall값을 나타내어 RGB영상 기반 대비 큰 성능 향상을 나타내었다. Class 1 또한 전체적으로 안정적으로 높은 값이 유지되었다.

UAV 기반 다중분광 영상은 고해상도와 다양한 스펙트럼 정보를 활용함으로써 RGB영상 대비 도복 탐지에서 더 높은 정확도와 예측 일관성을 제공하는 것으로 보고되었으며(Chauhan et al., 2019b; Zhao et al., 2020), 본 연구에서도 이러한 특성이 확인되어 다중분광 영상 기반 모델이 각 클래스간 경계에서 보다 정밀한 구분을 수행하고 Field 1 내 다양한 도복 형태와 복잡한 배경 조건에서도 안정적인 예측 성능을 유지함이 입증되었다.

클래스별 면적 변화 및 변수 중요도 분석

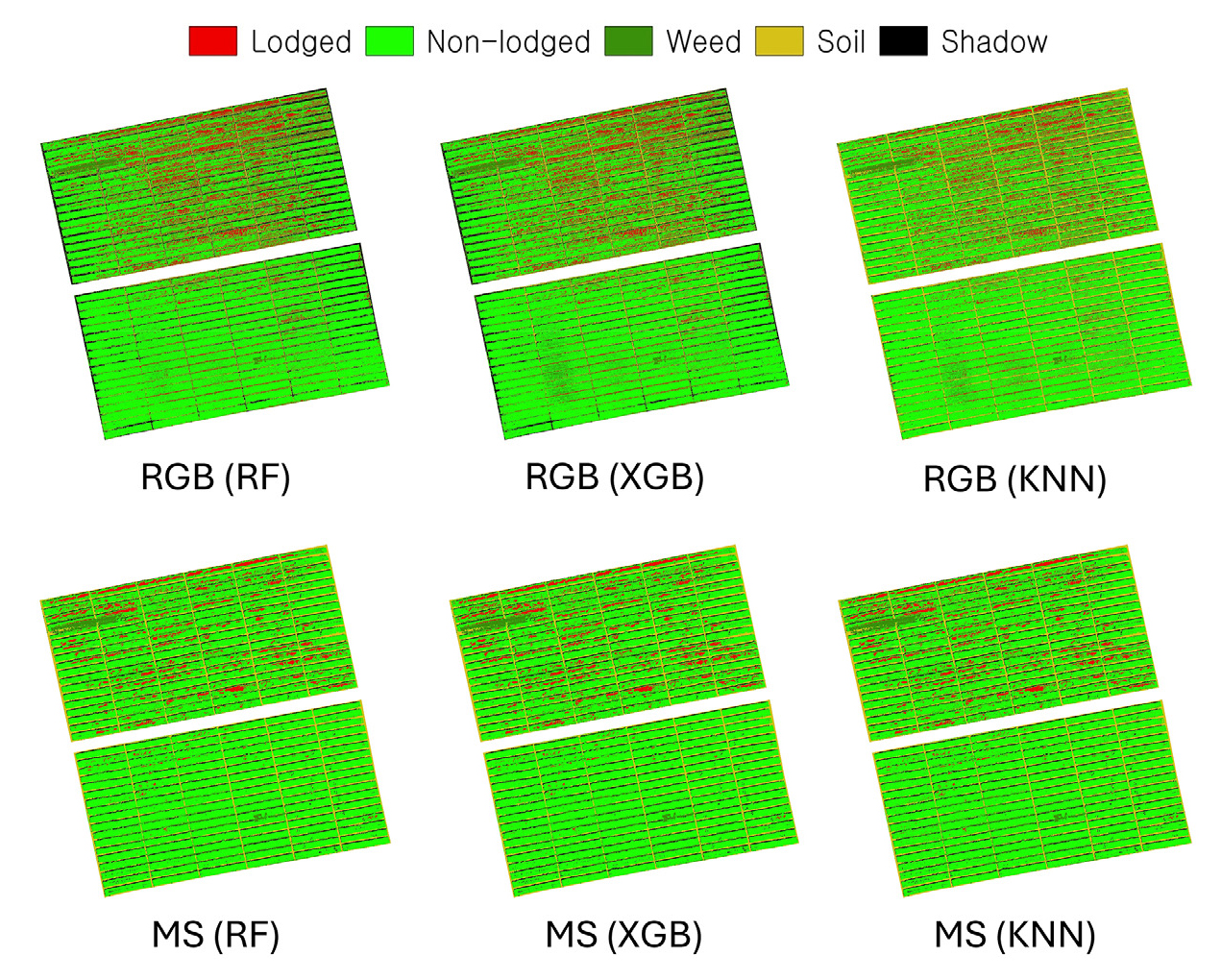

Field 1과 Field 2에서 RGB 및 다중분광 영상 기반 모델을 활용하여 도복 밀(Lodge), 비도복 밀(Wheat), 잡초(Weed), 토양(Soil), 그림자(Shadow) 5가지 클래스를 분류한 결과를 공간분포 지도로 작성하였다(Fig. 6).

RGB 영상 기반 공간분포 지도에서는 전반적으로 도복 밀의 영역이 Field 1에서 전체적으로 넓게 분포하는 경향이 나타나며, 이는 가시광 밴드(Red, Green, Blue)영역의 제한된 정보를 통해 도복과 비도복 밀 또는 잡초간의 반사 특성 차이를 세밀하게 구분함에 한계점이 있음을 시사한다.

반면 다중분광 영상 기반 모델은 NIR과 Red-Edge의 추가적인 밴드의 활용을 통해 분류 클래스 간 스펙트럼 차이를 더 정밀하게 구분할 수 있고, 그 결과 RGB 영상기반 모델 대비 도복 밀의 분포가 균일하게 표현되는 경향성과 Field 간 시각적 일관성이 높은 것을 확인하였다.

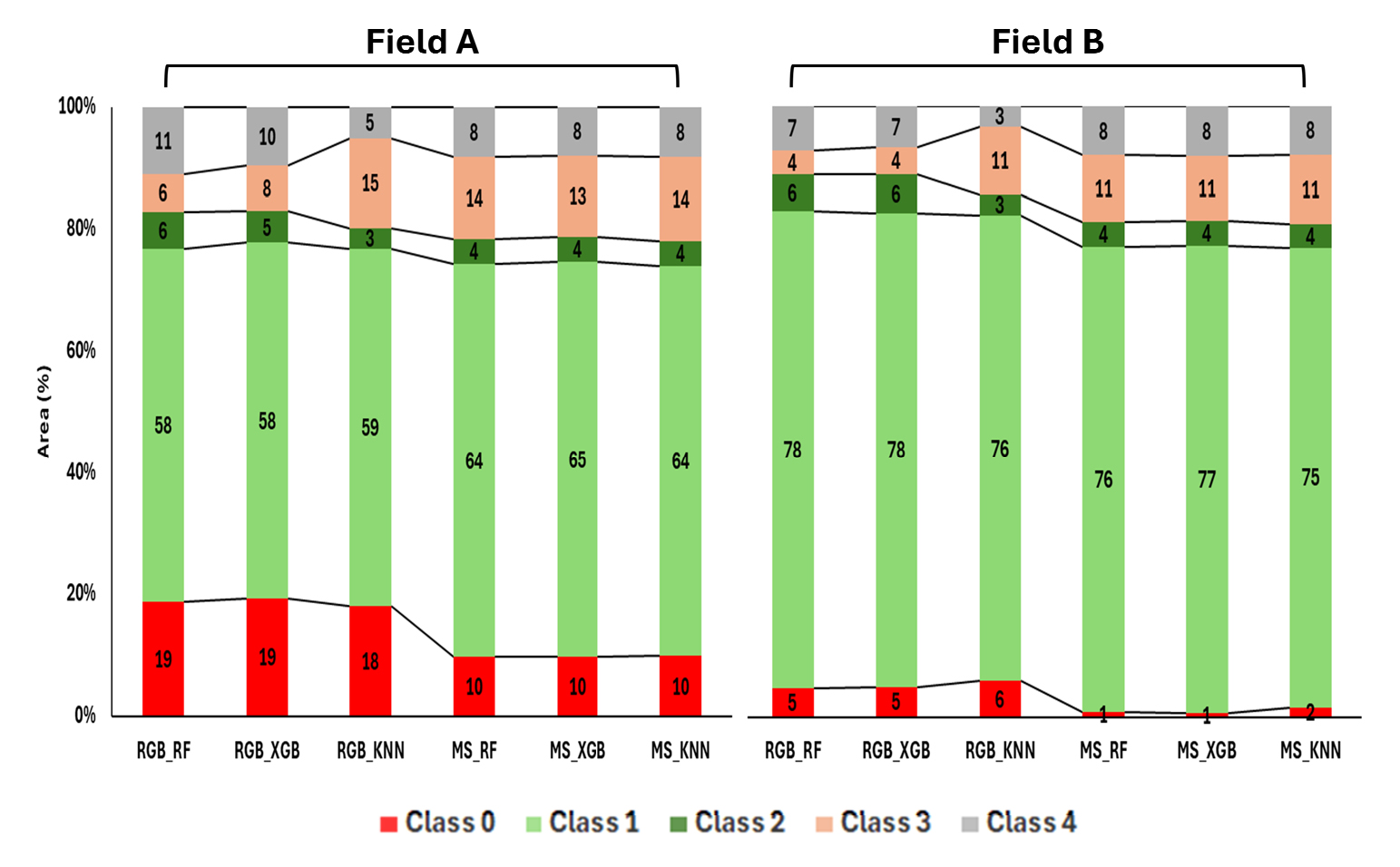

이러한 시각적 차이는 Fig. 7의 면적 분석에서도 수치적으로 확인되었으며, 분류 클래스별 면적 비율에서는 동일한 필드 내에서도 영상 종류와 기계학습 조합에 따라 면적 추정 결과가 뚜렷하게 달라졌다(Fig. 7).

특히 RGB영상, 다중분광영상에 따라 전체적인 분류 경향의 확연한 차이가 확인되었고, 동일한 영상에 적용된 기계학습 차이에 따른 면적의 변동도 확인되었다.

도복 밀(Class 0) 면적의 경우, Field 1에서 RGB 영상 기반 RF와 XGB가 각각 19%, KNN이 18%로 유사하였으나, 다중분광 영상 기반 모델은 약 10%로 절반 수준에 불과했다. Field 2에서도 RGB 영상 기반 분류는 5~6%였던 반면, 다중분광 영상 기반 분류는 1~2%로 더 낮게 추정되었다.

즉, 두 필드 모두에서 RGB 영상 기반 모델은 도복 면적을 과대 추정하는 경향이 나타난 반면에, 다중분광 영상 기반은 상대적으로 안정적이고 보수적인 면적 추정을 보였다.

이는 RGB 영상이 가시광 영역만으로는 도복 밀(Class 0)과 비도복 밀(Class 1)및 잡초(Class 2를 명확히 구분하기 어려워 일부 영영이 도복 밀로 잘못 분류되었기 때문으로 판단된다.

반면, 다중분광 영상 기반 모델은 NIR과 Red-Edge 밴드를 활용하여 클래스간 스펙트럼 차이를 정밀하게 분리함으로써 과대 추정을 효과적으로 억제한 것으로 해석된다.

비도복 밀(Class 1) 면적 비율에서도 영상 간 차이가 뚜렷하게 나타났다. Field 1에서 RGB 영상 기반 모델은 58~59%, 다중분광 영상 기반 모델은 64~65% 범위로 다중분광 영상 기반 모델이 더 높은 비도복 밀(Class 1) 비율을 보였으며, Field 2에서는 두 영상별 76~78%과 75~77%로 유사하게 나타났다.

Field 2에서는 두 영상 모두 75~78%로 유사하게 나타났는데, 이는 해당 시험포장에서 도복 발생 면적이 상대적으로 작아 비도복 밀 면적이 영상 종류와 무관하게 높게 유지되었기 때문으로 해석된다. 따라서 Field 1에서 보인 RGB 영상 대비 다중분광 영상의 우세는, 도복 면적 분포와 간접적으로 연관된 결과로 볼 수 있다.

잡초(Class 2) 면적은 전반적으로 두 영상 간 차이가 크지 않았으나, Field 1에서 RGB 영상 기반 모델은 5~6%로 약간 높았고 다중분광 영상 기반 모델은 3~4%를 기록했다. 이는 RGB 영상이 도복 밀(Class 0)과 잡초(Class 2)의 반사 특성을 충분히 분리하지 못해 일부 잡초가 도복 밀로 혼동된 영향으로 해석된다.

토양(Class 3)의 경우 영상의 종류보다 모델에 따른 변동이 더욱 뚜렷하게 나타났다. RGB 영상 기반 모델은 Field 1에서 6~15%, Field 2에서 4~11%까지 넓은 변동폭을 보였으나, 다중분광 영상 기반 모델은 상대적으로 좁은 범위에서 안정적인 면적값을 유지하였다.

이는 RGB 영상이 토양과 밀 포장 내 다른 클래스 간의 경계 구분에서 일관성을 확보하기 어렵다는 한계를 보여준다.

그림자(Class 4)는 다중분광 영상 기반 모델에서 Field 1과 2 모두 8%로 일정하게 유지되었으나, RGB 영상 기반 모델은 Field 1에서 5~11%, Field 2에서 3~7%로 변동성이 컸다. 이는 다중분광 영상의 추가 밴드 정보가 광조건 변화에 따른 분류 불안정을 완화하는 효과를 제공했음을 시사한다.

RGB 영상 기반과 다중분광 영상 기반 모두에서 RF, XGB, KNN간 도복 밀(Class 0) 면적 추정치 차이는 1~2% 이내로 크지 않았다.

이는 세 모델 모두 동일한 입력 변수 구조를 사용함에 따라 학습 과정에서 클래스 간 경계 설정이 유사하게 이루어졌기 때문으로, 영상 종류에 따른 차이가 기계학습 모델 간 차이보다 도복 면적 추정 결과에 더 큰 영향을 미쳤음을 보여준다.

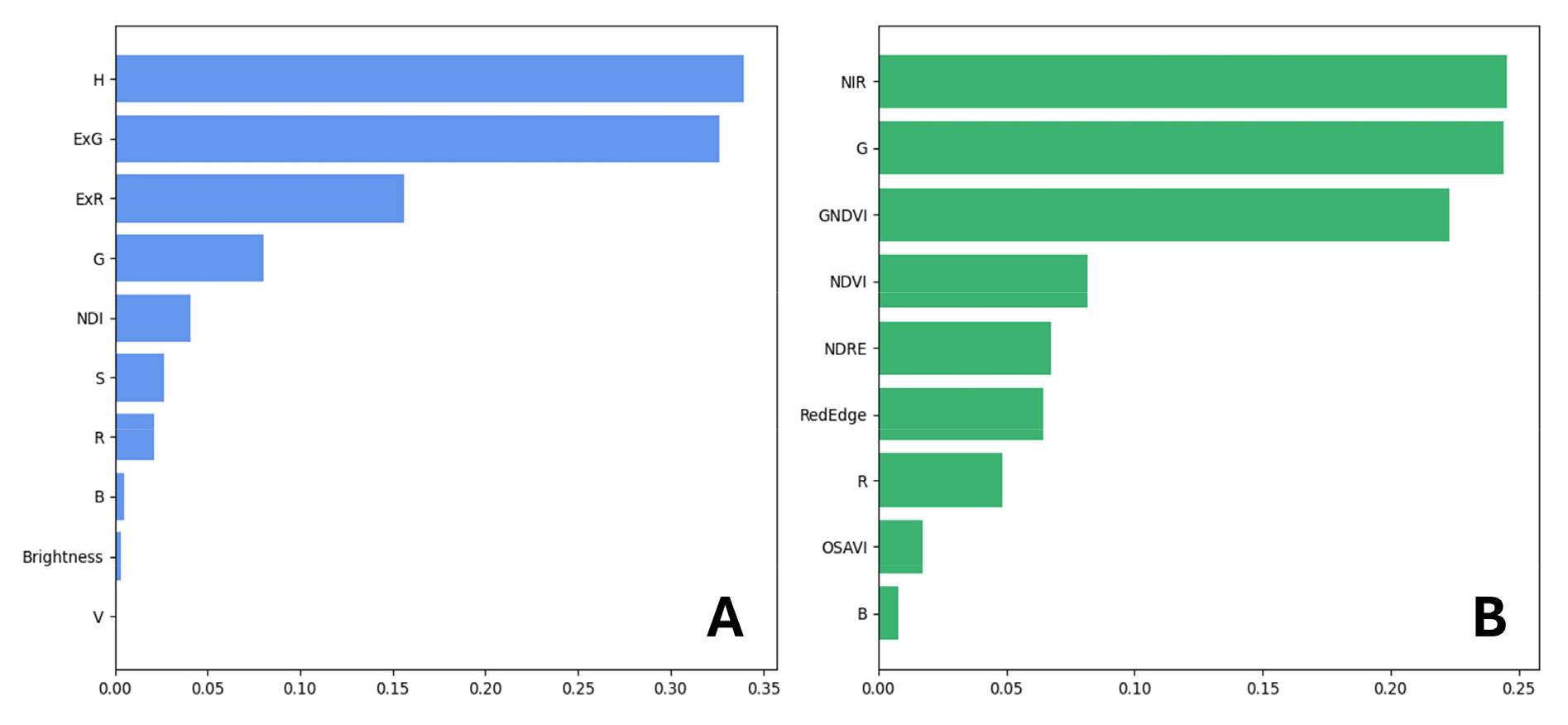

다중분광 영상 기반 XGB 모델의 활용이 밀 재배지에서의 도복 탐지에서 가장 우수한 성능을 보임에 따라, RGB 영상 기반 XGB 모델과 비교하여 도복 탐지에 기여하는 주요 변수를 규명하고 특성을 파악하고자 Feature Importance 분석을 수행하였다(Fig. 7).

RGB 영상 기반 XGB 모델(Fig. 8A)에서는 H (Hue, 중요도 약 0.21), ExG (Excess Green Index, 0.18), ExR (Excess Red Index, 0.15), G (Green, 0.13), NDI (Normalized Different Index, 0.11) 순으로 상위 변수들이 도출되었다. 이 중 H (Hue)와 ExG (Excess Green Index)는 Class 0(도복 밀)과 Class 1(비도복 밀) 간 색조 및 채도 차이를 반영하여 RGB 영상에서 도복을 구분하는데 핵심적인 역할을 한 것으로 판단된다.

반면 다중분광 영상 기반 XGB 모델(Fig. 8B)에서는 NIR (Near-Infrared) 밴드가 가장 높은 중요도(0.24)를 보였고, NDVI (0.19), NDRE (0.16), GNDVI (0.14)와 같은 NIR기반의 식생지수도 상위권에 포함되었다. 이러한 결과는 국내외 UAV 기반 원격탐사 연구에서 NIR과 Red-Edge 밴드의 중요성이 반복적으로 보고된 사실과 일치한다(Bhargava & Mariam, 1991; Chen et al., 1991).

즉, RGB 영상은 주로 가시광 영역의 색상과 채도 정보를 활용하여 도복을 구분한 반면, 다중분광 영상은 NIR과 Red-Edge 밴드가 제공하는 추가 스펙트럼 정보를 통해 도복 발생시 나타나는 식생의 생리적, 광학적 변화를 더욱 정밀하게 반영함으로써 탐지 정확도 향상에 기여했음을 보여준다.

Ground truth 기반 모델 검증

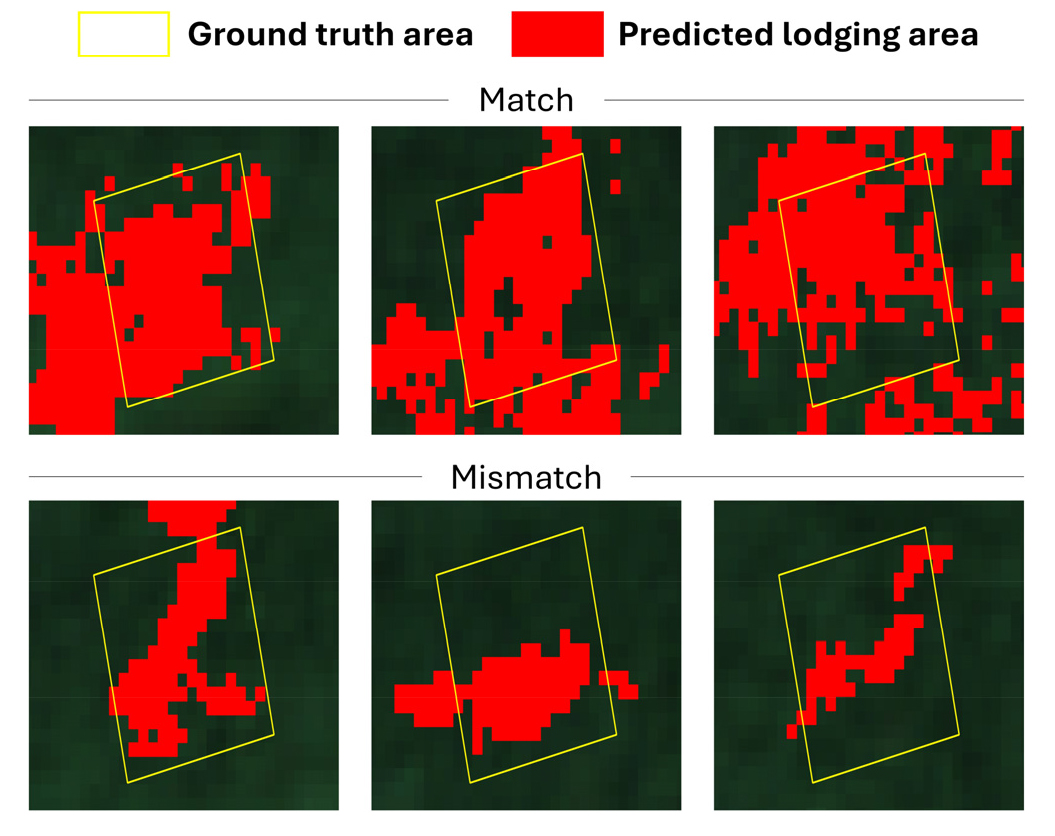

밀 재배지에서 영상을 활용한 도복 탐지의 적용 가능성을 검증하기 위해, Field 1에서 최적화된 다중분광 영상 기반 XGB 모델 조합을 Field 2에 적용 하여 독립 검정을 실시하고, 이를 통해 모델의 일반화 성능과 다양한 재배 환경에서의 활용 잠재력을 평가하였다.

다중분광 영상 기반 XGB 모델을 적용한 Field 2의 Prediction map에 대해 픽셀 기반 majority를 적용한 후 ground truth와 비교한 결과, 실제 도복 지점 상당수가 도복으로 정확히 판독되었다. 그러나 일부 도복 구역은 다수의 픽셀이 비도복으로 분류되어 최종적으로 비도복으로 판정되는 사례가 관찰되었다(Fig. 9).

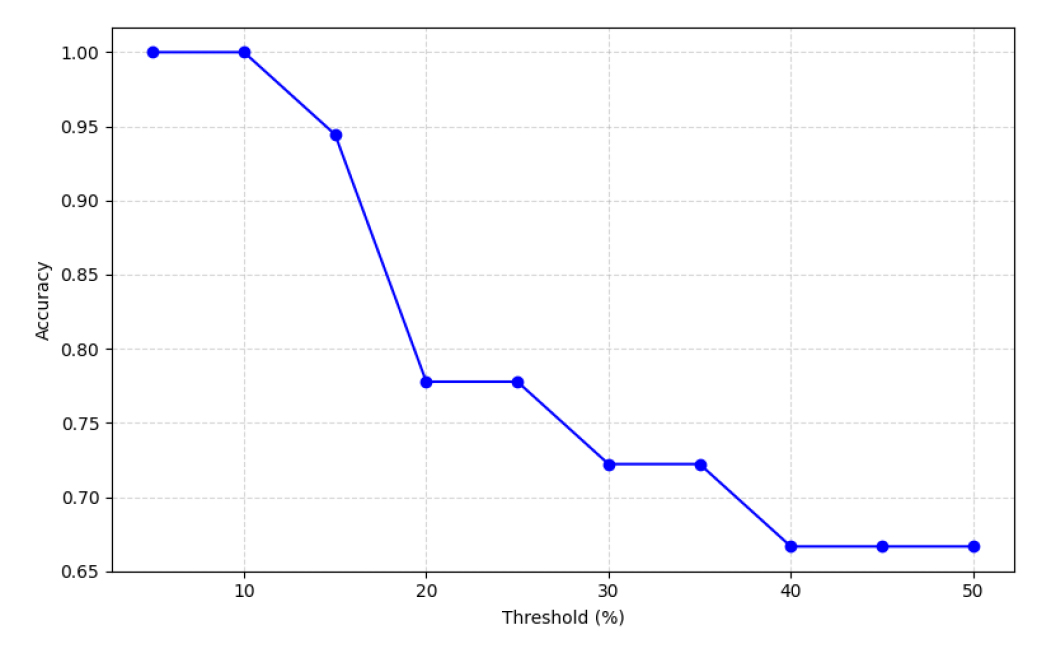

이러한 문제를 보완하기 위해 threshold값 조정에 따른 Prediction map의 정확도 변화를 분석하여 과대 탐지와 과소 탐지 간 균형을 최적화 하였다(Fig. 10).

도복 탐지를 위한 분류 모델에서는 픽셀 기반 majority 결정 또는 threshold 설정에 따른 과대/과소 탐지 균형이 중요한 변수로 작용한다. 이에 따라, 임계값의 변화가 분류 정확도에 미치는 영향을 체계적으로 분석하는 과정이 필수적으로 요구된다.

Threshold의 설정값이 5~10%일 때 정확도는 1.0으로 가장 높게 유지되었으며, 15%에서 약 0.95, 20~25% 구간에서 약 0.78로 하락하였다. 30% 이상에서는 정확도가 0.72 이하 수준으로 지속적인 감소경향을 나타내다, 40% 이상에서는 0.66의 값을 유지하였다.

위와 같은 결과는 threshold 값을 낮게 설정할 때 전체적인 도복 탐지 정확도가 가장 높게 유지되며, 임계값 조정이 현장 적용 시 실제 신뢰도 향상 및 예측 성능 최적화에 중요한 역할을 한다는 연구보고와 일치하였다 (Wilke et al., 2019).

즉, 밀 재배지에서의 도복을 판독할 경우 다중분광 영상 기반 XGB 모델의 약 5~10%의 threshold 설정은 경계 불확실성을 수용함으로써 도복 영역을 포괄적으로 판정하게 하여 다양한 재배 환경에서도 모델의 예측 신뢰도를 높이고 안정적인 판정을 가능할 것으로 판단된다.

적 요

본 연구는 국내 밀 재배지에서 무인항공기(UAV) 기반 영상과 기계학습을 활용하여 도복 탐지의 정확도를 평가하고, 최적의 영상-모델 조합을 도출하는 것을 목적으로 하였다.

전라북도 김제시의 두 개 시험포장(Field 1, Field 2)에서 도복이 발생한 시점에 RGB 및 다중분광 영상을 촬영하고, RF (Random Forest), XGB (XGBoost), KNN (K-Nearest Neighbors) 기계학습을 적용하여 도복 탐지 모델을 구축하였다.

Field 1의 학습(Train)과 검증(Validation) 결과, 다중분광 영상은 RGB 영상에 비해 모든 기계학습 모델에서 높은 성능을 보였으며, 특히, 다중분광 영상 기반 XGB 모델에서 가장 높은 정확도와 안정성을 나타내었다.

독립 검증용 Field 2에 다중분광 영상 기반 XGB 모델을 적용한 결과, Prediction map이 Ground truth와 전반적으로 유사한 공간분포를 보였으나 픽셀기반 majority 판정에서 일부 도복 구역이 비도복으로 분류되는 사례가 관찰되었다.

이를 보완하기 위해 threshold 값을 조정한 결과, Field 2의 Prediction Accuracy는 최적 threshold(5~10%)에서 최대 1.0까지 향상되었다.

본 연구를 통해 UAV 기반 다중분광 영상을 활용한 XGB 모델이 밀 재배지에서의 도복 탐지에 효과적임을 확인하였다. 또한, 도복을 조기에 탐지하고 그 변화를 정량적으로 평가함으로써 밀의 단백질 함량과 같은 품질에 영향을 미치는 요인을 신속하게 파악할 수 있는 가능성을 제시하였다.

이러한 접근은 도복 피해 예측뿐 아니라 품질 유지와 생산성 향상을 위한 실질적 의사 결정 지원에도 기여할 것으로 기대된다.

다만 본 연구는 밀의 생육 기간중 출수기 이후의 단일 UAV 영상을 기반으로 하였다는 한계가 있으며, 도복 발생의 시기적 변화를 충분히 반영하지 못하였다. 실제 농업 현장에서는 도복 발생 시기와 진행 양상에 따라 관리 대책이 달라질 수 있으므로, 특정 생육시기의 단일 영상은 피해 구역의 조기 탐지에는 유용하지만, 장기적 관리 의사결정을 지원하기 위해서는 시계열 영상(Time-series imagery)의 확보가 필수적이라 판단된다.

또한, 본 연구는 특정 생육 단계에서 수행되었기에 밀의 전체적인 생육기간과 다양한 환경 조건에서도 동일한 정확도를 나타낼 것이라 단정할 수 없으나, 다중분광 영상의 NIR 및 Red-Edge 밴드가 도복 탐지에서 높은 기여도를 보였다는 점은 다른 생육단계에서도 일정 수준의 활용 가능성을 시사한다.

따라서 향후에는 다양한 생육시기와 재배 환경 조건에서 축적된 데이터를 활용한 검증을 통해 현장에서의 적용 가능성을 높일 필요가 있으며, 이러한 후속 연구가 적극적으로 수행되어야 할 것이다.